分布式存储网络 神经网络和深度学习简史(全)(16)

电脑杂谈 发布时间:2018-02-11 16:43:15 来源:网络整理这并不是说公司这么做是为了慈善。这是他们所有人探索如何把技术商业化的开始,其中最为突出的是谷歌。但是也许并非Hinton,而是吴恩达造成了这一切,他促使公司成为世界最大的商业化采用者和技术用户者。在2011年,吴恩达在巡视公司时偶遇到了传说中的谷歌人Jeff Dean,聊了一些他用谷歌的计算资源来训练神经网络所做的努力。

这使Dean着迷,于是与吴恩达一起创建了谷歌大脑(Google Brain)——努力构建真正巨大的神经网络并且探索它们能做什么。这项工作引发了一个规模前所未有的无监督式神经网络学习——16000个CPU核,驱动高达10亿权重的学习(作为比较,Hinton在2006年突破性的DBN大约有100万权重)。神经网络在YouTube视频上被训练,完全无标记,并且学着在这些视频中去辨认最平常的物体——而神经网络对于猫的发现,引起了互联网的集体欢乐。

谷歌最著名的神经网络学习猫。这是输入到一个神经元中最佳的一张。

它很可爱,也很有用。正如他们常规发表的一篇论文中所报道的,由模型学习的特征能用来记录标准的计算机视觉基准的设置性能。

这样一来,谷歌训练的神经网络的内部工具诞生了,自此他们仅需继续发展它。深度学习研究的浪潮始于2006年,现在已经确定进入行业使用。

深度学习的上升

当深度学习进入行业使用时,研究社区很难保持平静。有效的利用GPU和计算能力的发现是如此重要,它让人们检查长久存疑的假设并且问一些也许很久之前被提及过的问题——也就是,反向传播到底为何没什么用呢?为什么旧的方法不起作用,而不是新的方法能奏效,这样的问题观点让Xavier Glort 和 Yoshua Bengio在2010年写了「理解训练深度前馈神经网络的难点」(Understanding the difficulty of training deep feedforward neural networks)一文。分布式存储网络

在文中,他们讨论了两个有重大意义的发现:

1.为神经网络中神经元选取的特定非线性激活函数,对性能有巨大影响,而默认使用的函数不是最好的选择。

2.相对于随机选取权重,不考虑神经层的权重就随机选取权重的问题要大得多。以往消失的梯度问题重现,根本上,由于反向传播引入一系列乘法,不可避免地导致给前面的神经层带来细微的偏差。就是这样,除非依据所在的神经层不同分别选取不同的权重 ——否则很小的变化会引起结果巨大变化。

不同的激活函数。ReLU是**修正线性单元**

第二点的结论已经很清楚了,但是第一点提出了这样的问题:『然而,什么是最好的激活函数?』有三个不同的团队研究了这个问题:LeCun所在的团队,他们研究的是「针对对象识别最好的多级结构是什么?」;另一组是Hinton所在的团队,研究「修正的线性单元改善受限玻尔兹曼机器」;第三组是Bengio所在的团队——「深度稀缺的修正神经网络」。他们都发现惊人的相似结论:近乎不可微的、十分简单的函数f(x)=max(0,x)似乎是最好的。令人吃惊的是,这个函数有点古怪——它不是严格可微的,确切地说,在零点不可微,因此 就 数学而言论文看起来很糟糕。但是,清楚的是零点是很小的数学问题——更严重的问题是为什么这样一个零点两侧导数都是常数的简单函数,这么好用。答案还未揭晓,但一些想法看起来已经成型:

修正的激活导致了表征稀疏,这意味着在给定输入时,很多神经元实际上最终需要输出非零值。这些年的结论是,稀疏对深度学习十分有利,一方面是由于它用更具鲁棒性的方式表征信息,另一方面由于它带来极高的计算效率(如果大多数的神经元在输出零,实际上就可以忽略它们,计算也就更快)。顺便提一句,计算神经科学的研究者首次在大脑视觉系统中引入稀疏计算,比机器学习的研究早了10年。

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-72116-16.html

-

-

冯宝婧

冯宝婧你们就完蛋了

-

赵建革

赵建革要是美帝能保证伊国领土不被伊凡份子攻占

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk

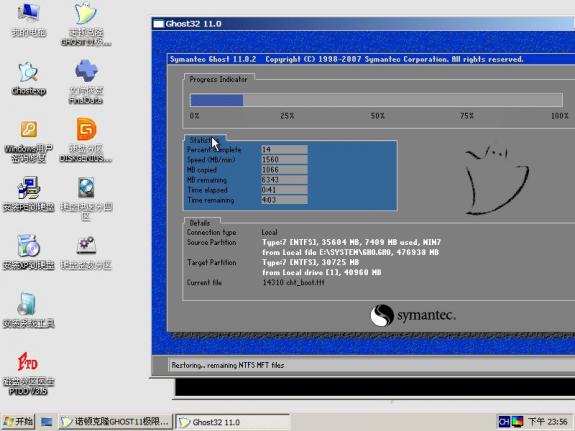

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk 技术员联盟ghost win7 64位装机版v2016.01

技术员联盟ghost win7 64位装机版v2016.01 链表结构 java代码_java数组_链表结构 java代码

链表结构 java代码_java数组_链表结构 java代码 综合解决方案:紫光一键重装系统

综合解决方案:紫光一键重装系统

说的真好