分布式存储网络 神经网络和深度学习简史(全)(14)

电脑杂谈 发布时间:2018-02-11 16:43:15 来源:网络整理他们还提出了为什么附加非监督式预训练,并总结这不仅仅以更优化的方式初始权重,而且更加重要的是导致了更有用的可学习数据显示,让算法可以有更加普遍化的模型。实际上,利用RBM并不是那么重要——普通神经网络层的非监督式预训练利用简单的自动代码层反向传播证明了其有效性。同样的,与此同时,另一种叫做分散编码的方法也表明,非监督式特征学习对于改进监督式学习的性能非常有力。

因此,关键在于有着足够多的显示层,这样优良的高层数据显示能够被学习——与传统的手动设计一些特征提取步骤并以提取到的特征进行机器学习方式完全不同。Hinton与Bengio的工作有着实践上的证明,但是更重要的是,展示了深层神经网络并不能被训练好的假设是错误的。LeCun已经在整个九十年代证明了CNN,但是大部分研究团体却拒绝接受。Bengio与Yann LeCun一起,在「实现AI的算法(Scaling Algorithms Towards AI)」研究之上证明了他们自己:

「直至最近,许相信训练深层架构是一个太过困难的优化问题。然而,至少有两个不同的方法对此都很有效:应用于卷积神经网络的简单梯度下降[LeCun et al., 1989, LeCun et al., 1998](适用于信号和图像),以及近期的逐层非监督式学习之后的梯度下降[Hinton et al., 2006, Bengio et al., 2007, Ranzato et al., 2006]。深层架构的研究仍然处于雏形之中,更好的学习算法还有待发现。从更广泛的观点来看待以发现能够引出AI的学习准则为目标这事已经成为指导性观念。我们希望能够激发他人去寻找实现AI的机器学习方法。」

他们的确做到了。或者至少,他们开始了。尽管深度学习还没有达到今天山呼海应的效果,它已经如冰面下的潜流,不容忽视地开始了涌动。那个时候的成果还不那么引人注意——大部分论文中证明的表现都限于MNIST,一个经典的机器学习任务,成为了十年间算法的标准化基准。Hinton在2006年发布的论文展现出惊人的错误率,在测试集上仅有1.25%的错误率,但SVMs已经达到了仅1.4%的错误率,甚至简单的算法在个位数上也能达到较低的错误率,正如在论文中所提到的,LeCun已经在1998年利用CNNs表现出0.95%的错误率。

因此,在MNIST上做得很好并不是什么大事。意识到这一点,并自信这就是深度学习踏上舞台的时刻的Hinton与他的两个,Abdel-rahman Mohamed和George Dahl,展现了他们在一个更具有挑战性的任务上的努力:语音识别( Speech Recognition)。

利用DBN,这两个学生与Hinton做到了一件事,那就是改善了十年间都没有进步的标准语音识别数据集。这是一个了不起的成就,但是现在回首来看,那只是暗示着即将到来的未来——简而言之,就是打破更多的记录。

蛮力的重要性

上面所描述的算法对于深度学习的出现有着不容置疑的重要性,但是自上世纪九十年始,也有着其他重要组成部分陆续出现:纯粹的计算速度。随着摩尔定律,计算机比起九十年代快了数十倍,让大型数据集和多层的学习更加易于处理。但是甚至这也不够——CPU开始抵达速度增长的上限,计算机能力开始主要通过数个CPU并行计算增长。为了学习深度模型中常有的数百万个权重值,脆弱的CPU并行限制需要被抛弃,并被具有大型并行计算能力的GPUs所代替。意识到这一点也是Abdel-rahman Mohamed,George Dahl与Geoff Hinton做到打破语音识别性能记录的部分原因:

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-72116-14.html

-

-

薛又川

薛又川我姐姐明明最高

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk

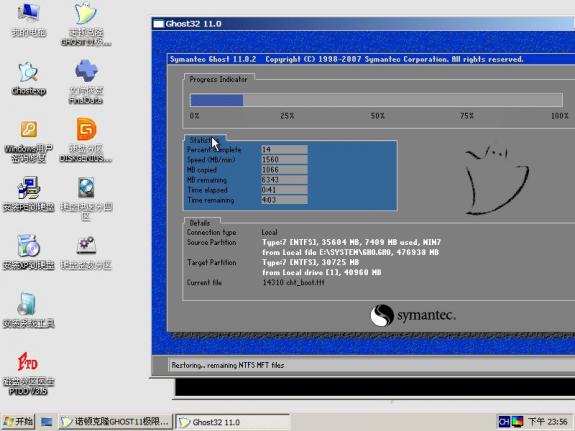

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk 技术员联盟ghost win7 64位装机版v2016.01

技术员联盟ghost win7 64位装机版v2016.01 链表结构 java代码_java数组_链表结构 java代码

链表结构 java代码_java数组_链表结构 java代码 综合解决方案:紫光一键重装系统

综合解决方案:紫光一键重装系统

这点可以学朝鲜一下下