分布式存储网络 神经网络和深度学习简史(全)(12)

电脑杂谈 发布时间:2018-02-11 16:43:15 来源:网络整理通过时间顺序扁平化BP路径本质上跟具有许多层的神经网络一样,所以,用反向传播来训练递归神经网络是比较困难的。由Schmidhuber指导的Sepp Hochreiter及Yoshua Bengio都写过文章指出,由于反向传播的限制,学习长时间的信息是行不通的。分析问题以后其实是有解决办法的,Schmidhuber 及 Hochreiter在1997年引进了一个十分重要的概念,这最终解决了如何训练递归神经网络的问题,这就是长短期记忆(Long Short Term Memory, LSTM)。简言之,卷积神经网络及长短期记忆的突破最终只为正常的神经网络模型带来了一些小改动:

LSTM的基本原理十分简单。当中有一些单位被称为恒常误差木马(Constant Error Carousels, CECs)。每个CEC使用一个激活函数 f,它是一个恒常函数,并有一个与其自身的连接,其固定权重为1.0。由於 f 的恒常导数为1.0,通过CEC的误差反向传播将不会消失或爆炸(5.9节),而是保持原状(除非它们从CEC「流出」到其他一些地方,典型的是「流到」神经网络的自适应部分)。CEC被连接到许多非线性自适应单元上(有一些单元具有乘法的激活函数),因此需要学习非线性行为。单元的权重改变经常得益于误差信号在时间里通过CECs往后传播。为什么LSTM网络可以学习探索发生在几千个离散时间步骤前的事件的重要性,而之前的递归神经网络对于很短的时间步骤就已经失败了呢?CEC是最主要的原因。

但这对于解决更大的知觉问题,即神经网络比较粗糙、没有很好的表现这一问题是没有太大帮助的。用它们来工作是十分麻烦的——电脑不够快、算法不够聪明,人们不开心。所以在九十年代左右,对于神经网络一个新的AI寒冬开始来临——社会对它们再次失去信心。一个新的方法,被称为支持向量机(Support Vector Machines),得到发展并且渐渐被发现是优于先前棘手的神经网络。简单的说,支持向量机就是对一个相当于两层的神经网络进行数学上的最优训练。事实上,在1995年,LeCun的一篇论文,「 Comparison of Learning Algorithms For Handwritten Digit Recognition」,就已经讨论了这个新的方法比先前最好的神经网络工作得更好,最起码也表现一样。

支持向量机分类器具有非常棒的准确率,这是最显著的优点,因为与其他高质量的分类器比,它对问题不包含有先验的知识。事实上,如果一个固定的映射被安排到图像的像素上,这个分类器同样会有良好的表现。比起卷积网络,它依然很缓慢,并占用大量内存。但由于技术仍较新,改善是可以预期的。

另外一些新的方法,特别是随机森林(Random Forests),也被证明十分有效,并有强大的数学理论作为后盾。因此,尽管递归神经网络始终有不俗的表现,但对于神经网络的热情逐步减退,机器学习社区再次否认了它们。寒冬再次降临。

深度学习的密谋

当你希望有一场革命的时候,那么,从密谋开始吧。随着支持向量机的上升和反向传播的失败,对于神经网络研究来说,上世纪早期是一段黑暗的时间。Lecun与Hinton各自提到过,那时他们以及他们学生的论文被拒成了家常便饭,因为论文主题是神经网络。上面的引文可能夸张了——当然机器学习与AI的研究仍然十分活跃,其他人,例如Juergen Schmidhuber也正在研究神经网络——但这段时间的引用次数也清楚表明兴奋期已经平缓下来,尽管还没有完全消失。在研究领域之外,他们找到了一个强有力的同盟:加拿大政府。CIFAR的资助鼓励还没有直接应用的基础研究,这项资助首先鼓励Hinton于1987年搬到加拿大,然后一直资助他的研究直到九十年代中期。…Hinton 没有放弃并改变他的方向,而是继续研究神经网络,并努力从CIFAR那里获得更多资助,正如这篇例文()清楚道明的:

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-72116-12.html

-

-

元善见

元善见那你去找天津市领导吧

-

杨金和

杨金和正义的国家站在正义的立场应该坚决予以反击

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk

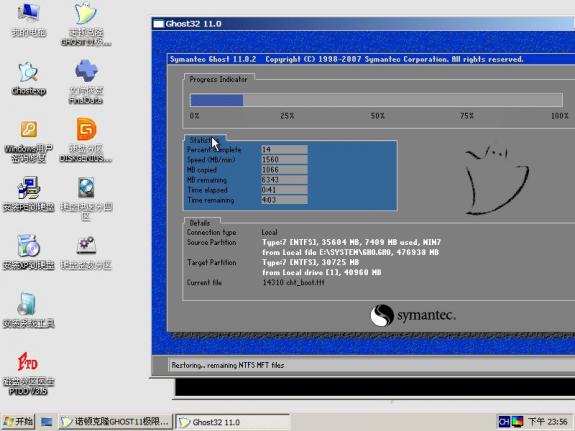

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk 技术员联盟ghost win7 64位装机版v2016.01

技术员联盟ghost win7 64位装机版v2016.01 链表结构 java代码_java数组_链表结构 java代码

链表结构 java代码_java数组_链表结构 java代码 综合解决方案:紫光一键重装系统

综合解决方案:紫光一键重装系统

晚安#易烊千玺#