分布式存储网络 神经网络和深度学习简史(全)(13)

电脑杂谈 发布时间:2018-02-11 16:43:15 来源:网络整理「但是,在2004年,Hinton要求领导一项新的有关神经计算的项目。主流机器学习社区对神经网络兴趣寡然。」

「那是最不可能的时候」Bengio是蒙特利尔大学的教授,也是去年重新上马的CIFAR项目联合主管,「其他每个人都在做着不同的事。莫名其妙地,Geoff说服了他们。」

「我们应该为了他们的那场豪赌大力赞许CIFAR。」

CIFAR「对于深度学习的社区形成有着巨大的影响。」LeCun补充道,他是CIFAR项目的另一个联合主管。「我们像是广大机器学习社区的弃儿:无法发表任何文章。这个项目给了我们交流思想的天地。」

资助不算丰厚,但足够让研究员小组继续下去。Hinton和这个小组孕育了一场密谋:用「深度学习」来「重新命名」让人闻之色变的神经网络领域。接下来,每位研究人员肯定都梦想过的事情真的发生了:2006年,Hinton、Simon Osindero与Yee-Whye Teh发表了一篇论文,这被视为一次重要突破,足以重燃人们对神经网络的兴趣:A fast learning algorithm for deep belief nets(论文参见:https://www.cs.toronto.edu/~hinton/absps/fastnc.pdf)。

正如我们将要看到的,尽管这个想法所包含的东西都已经很古老了,「深度学习」的运动完全可以说是由这篇文章所开始。但是比起名称,更重要的是如果权重能够以一种更灵活而非随机的方式进行初始化,有着多层的神经网络就可以得以更好地训练。

受限的玻尔兹曼机器

那么什么叫做初始化权重的灵活方法呢?实际上,这个主意基本就是利用非监督式训练方式去一个一个训练神经层,比起一开始随机分配值的方法要更好些,之后以监督式学习作为结束。每一层都以受限波尔兹曼机器(RBM)开始,就像上图所显示的隐藏单元和可见单元之间并没有连接的玻尔兹曼机器(如同亥姆霍兹机器),并以非监督模式进行数据生成模式的训练。事实证明这种形式的玻尔兹曼机器能够有效采用2002年Hinton引进的方式「最小化对比发散专家训练产品(Training Products of Experts by Minimizing Contrastive Divergence)」进行训练。

基本上,除去单元生成训练数据的可能,这个算法最大化了某些东西,保证更优拟合,事实证明它做的很好。因此,利用这个方法,这个算法如以下:

利用对比发散训练数据训练RBM。这是信念网络(belief net)的第一层。

生成训练后RBM数据的隐藏值,模拟这些隐藏值训练另一个RBM,这是第二层——将之「堆栈」在第一层之上,仅在一个方向上保持权重直至形成一个信念网络。

根据信念网络需求在多层基础上重复步骤2。

如果需要进行分类,就添加一套隐藏单元,对应分类标志,并改变唤醒-休眠算法「微调」权重。这样非监督式与监督式的组合也经常叫做半监督式学习。

Hinton引入的层式预训练

这篇论文展示了深度信念网络(DBNs)对于标准化MNIST字符识别有着完美的表现,超越了仅有几层的普通神经网络。Yoshua Bengio等在这项工作后于2007年提出了「深层网络冗余式逐层训练( “Greedy Layer-Wise Training of Deep Networks)」,其中他们表达了一个强有力的论点,深度机器学习方法(也就是有着多重处理步骤的方法,或者有着数据等级排列特征显示)在复杂问题上比浅显方法更加有效(双层ANNs或向量支持机器)。

关于非监督式预训练的另一种看法,利用自动代码取代RBM。

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-72116-13.html

-

-

佐久间玲

佐久间玲各种复杂添加剂

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk

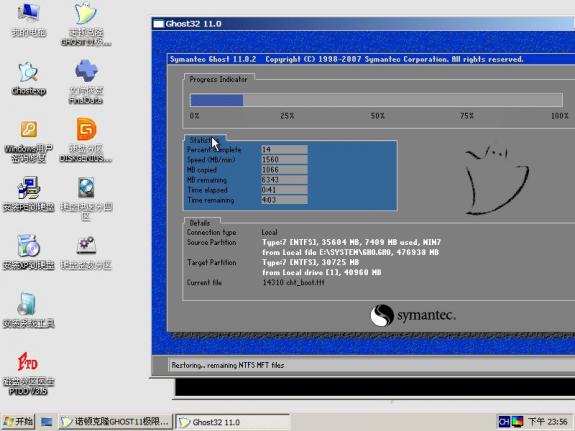

Pocket PC 2002 模拟器_windows mobile 5.0_win10mobile apk 技术员联盟ghost win7 64位装机版v2016.01

技术员联盟ghost win7 64位装机版v2016.01 链表结构 java代码_java数组_链表结构 java代码

链表结构 java代码_java数组_链表结构 java代码 综合解决方案:紫光一键重装系统

综合解决方案:紫光一键重装系统

统一是早晚的事