c 计算结构体大小 从90年代的SRNN开始,纵览循环神经网络27年的研究进展(5)

电脑杂谈 发布时间:2018-01-06 05:08:52 来源:网络整理3. 当前记忆内容

现在我们具体讨论一下这些门控到底如何影响最终的输出。在重置门的使用中,新的记忆内容将使用重置门储存过去相关的信息,它的计算表达式为:

输入 x_t 与上一时间步信息 h_(t-1) 先经过一个线性变换,即分别右乘矩阵 W 和 U。

计算重置门 r_t 与 Uh_(t-1) 的 Hadamard 乘积,即 r_t 与 Uh_(t-1) 的对应元素乘积。因为前面计算的重置门是一个由 0 到 1 组成的向量,它会衡量门控开启的大小。例如某个元素对应的门控值为 0,那么它就代表这个元素的信息完全被遗忘掉。该 Hadamard 乘积将确定所要保留与遗忘的以前信息。c 计算结构体大小

4. 当前时间步的最终记忆

在最后一步,网络需要计算 h_t,该向量将保留当前单元的信息并传递到下一个单元中。在这个过程中,我们需要使用更新门,它决定了当前记忆内容 h'_t 和前一时间步 h_(t-1) 中需要收集的信息是什么。这一过程可以表示为:

z_t 为更新门的激活结果,它同样以门控的形式控制了信息的流入。z_t 与 h_(t-1) 的 Hadamard 乘积表示前一时间步保留到最终记忆的信息,该信息加上当前记忆保留至最终记忆的信息就等于最终门控循环单元输出的内容。

G. 记忆网络

卷积 RNN 可用于储存过去输入特征的记忆容量较小 [71] [72]。记忆神经网络(MemNN)利用成功的学习方法和可读、可写的存储器进行推断。MemNN 是一个对象数组,包括输入、响应、泛化和输出特征图 [71] [73]。c 计算结构体大小它将输入转换成内部特征表示,然后根据新的输入更新记忆。之后使用输入和更新后的记忆计算输出特征,并将其解码来生成输出 [71]。使用 BPTT 训练该网络并不简单,每一层都需要监督 [74]。

循环记忆网络(RMN)利用 LSTM 和 MemNN [75]。RMN 中的记忆模块采用 LSTM 的隐藏状态,并使用注意力机制将它和最近的输入进行对比。RMN 算法分析已训练模型的注意力权重,并按时间从 LSTM 的保留信息中提取知识 [75]。

H. 结构受限循环神经网络

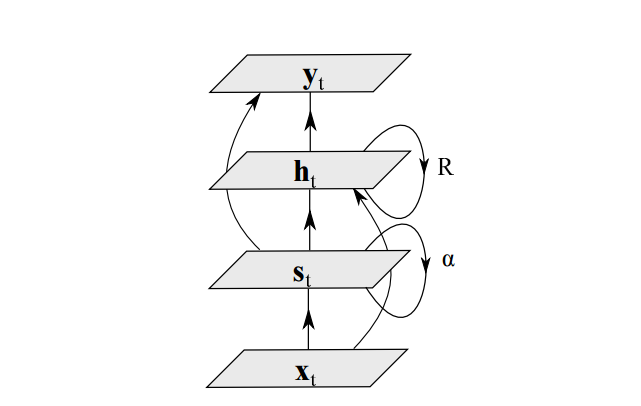

另一个解决梯度消失问题的模型是结构受限循环神经网络(structurally constrained recurrent neural network,SCRN)。这种网络基于隐藏状态在训练过程中快速变化的观察现象而设计,如图 12 所示 [6]。在这种方法中,SCRN 结构通过添加等价于单位长期依赖性关系的特定循环矩阵进行扩展。

图 12:带有语境特征(更长记忆)的循环神经网络

I. 酉循环神经网络

减缓梯度消失与梯度爆炸的一个简单方法是使用 RNN 中的酉矩阵(unitary matrices)。梯度消失与梯度爆炸问题归因于隐藏到隐藏权重矩阵的特征值之一的偏离。因此,为了防止这些特征值偏离,可用酉矩阵取代网络中的一般矩阵。

J. 门控正交循环单元(Gated Orthogonal Recurrent Unit)

门控正交循环单元使用正交矩阵取代隐藏状态循环矩阵(loop matrix),并引入了对 ReLU 激活函数的增强,使得它能够处理复数值输入 [77]。这种单元能够使用酉矩阵捕捉数据的长期依赖关系,同时还能利用 GRU 架构中的遗忘机制。

k. 层级子采样循环神经网络

层级子采样循环神经网络(HSRNN) 旨在通过使用固定的窗口大小进行每个层级的子采样,从而更好地学习长序列 [78]。训练这种网络遵循常规 RNN 训练的流程,然后根据每个层级的窗口大小进行略微修改。

以上是循环神经网络的 11 中架构,这一部分其实有详细的解释,但我们并没有深入讨论。该论文后面还讨论了 RNN 中的正则化技术,包括 L1 和 L2 正则化、Dropout、激活值稳定归一化和其它正则化方法。我们只是简要介绍了该论文的基本结构与概念,很多详细的推导与实现都需要读者深入阅读原论文。尽管如此,但本文从 RNN 的基础到循环架构还是全面概述了近年来 RNN 的研究与进步

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-58506-5.html

-

-

屋良有作

屋良有作

apache 配置这篇文章介绍怎样用web服务器列出指定的目

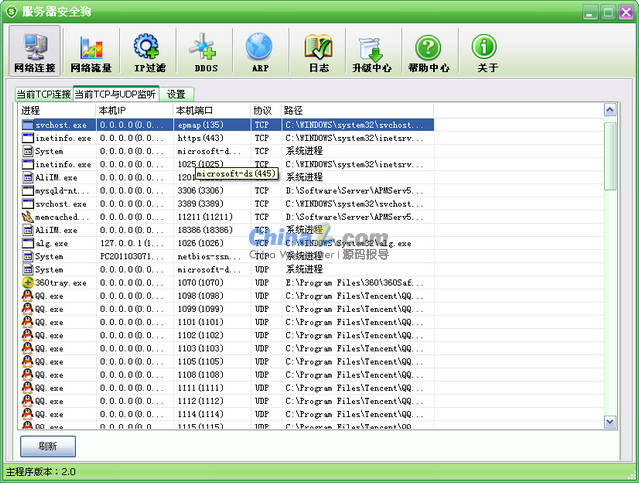

apache 配置这篇文章介绍怎样用web服务器列出指定的目 服务器安全防护软件 Exim邮件服务器漏洞安全预警再升级 御界系统全面护航企业安

服务器安全防护软件 Exim邮件服务器漏洞安全预警再升级 御界系统全面护航企业安 国外学术界典型品牌价值评价体系的比较研究

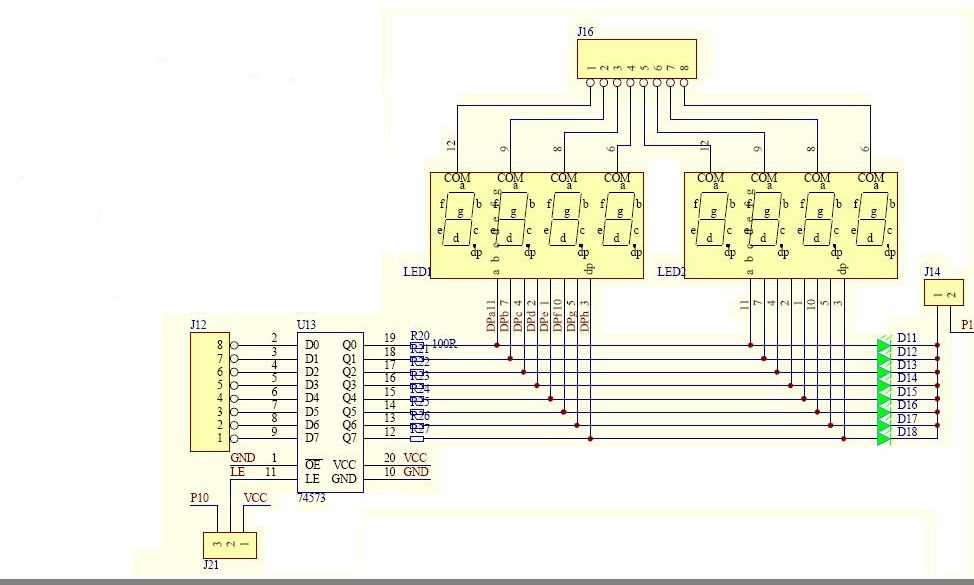

国外学术界典型品牌价值评价体系的比较研究 数字钟电路设计_数字钟电路板_数字钟电路原理图

数字钟电路设计_数字钟电路板_数字钟电路原理图

好好听