c 计算结构体大小 从90年代的SRNN开始,纵览循环神经网络27年的研究进展(3)

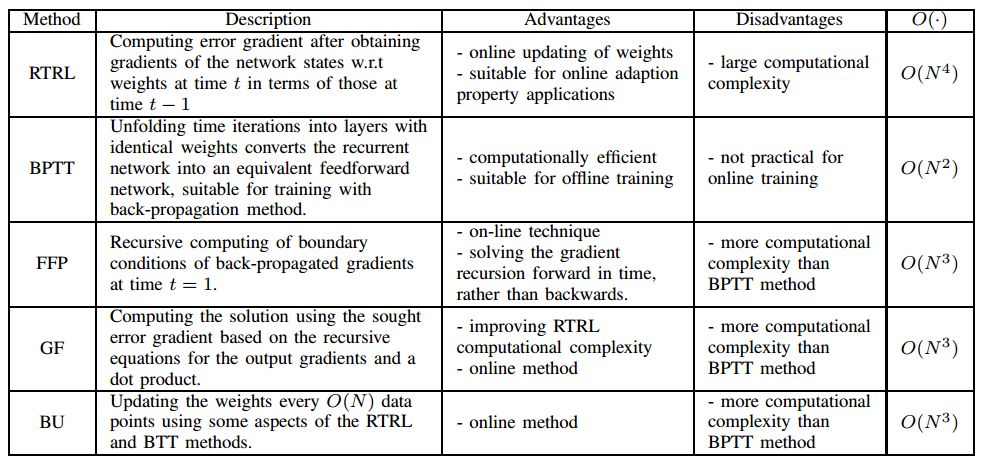

电脑杂谈 发布时间:2018-01-06 05:08:52 来源:网络整理该论文具体介绍了基于梯度的方法,下表展示了 GD 算法各种变体的优势缺点,其中 N 为神经网络的结点数、O(.) 为每个数据点的复杂度:

其中 BPTT 可能是非常流行的算法,如下所示,当网络随时间推移接收到新的输入,沿时间反向传播将重写激活函数中的隐藏单元。

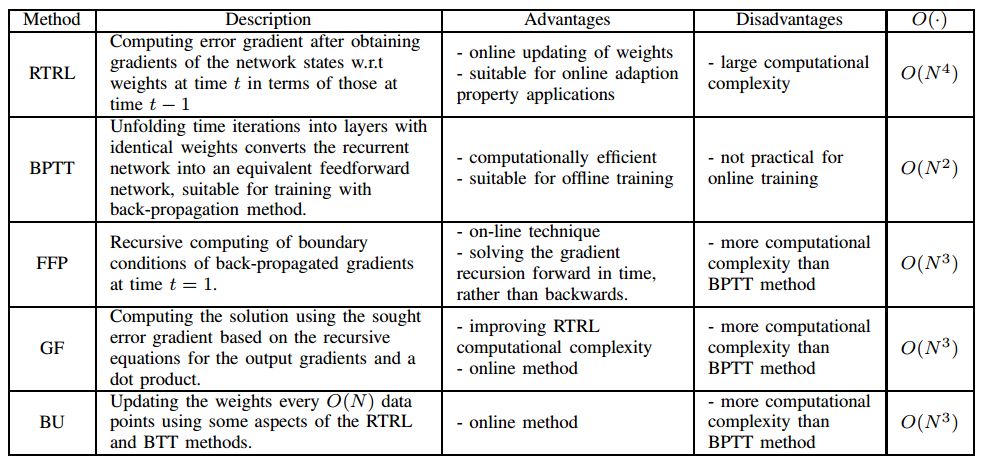

该论文还讨论了其它非常流行的 SGD 优化策略和二阶梯度优化,如下展示了一般动量法和 Nesterov 加速梯度法之间的差异。

这一部分还包含很多优化方法与策略,更详细的内容请查看原论文。

IV. 循环神经网络架构

在该论文中,作者描述了 11 种循环神经网络架构,而且每一种可能还包括一些变体,例如 LSTM 就有八种变体。但限于文章的篇幅,我们只简要介绍了这 11 种循环神经网络架构的基本概念,并且根据我们的理解和往期文章来介绍一般的 LSTM 与 GRU 结构,因此这两部分和论文中所描述的有一些不同。

A. 深度 RNN 结合多层感知机

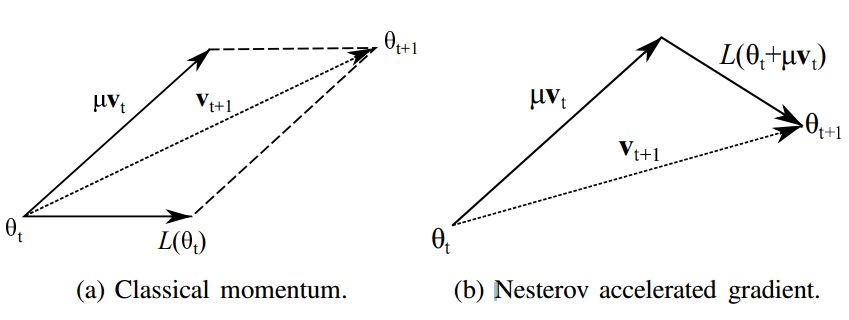

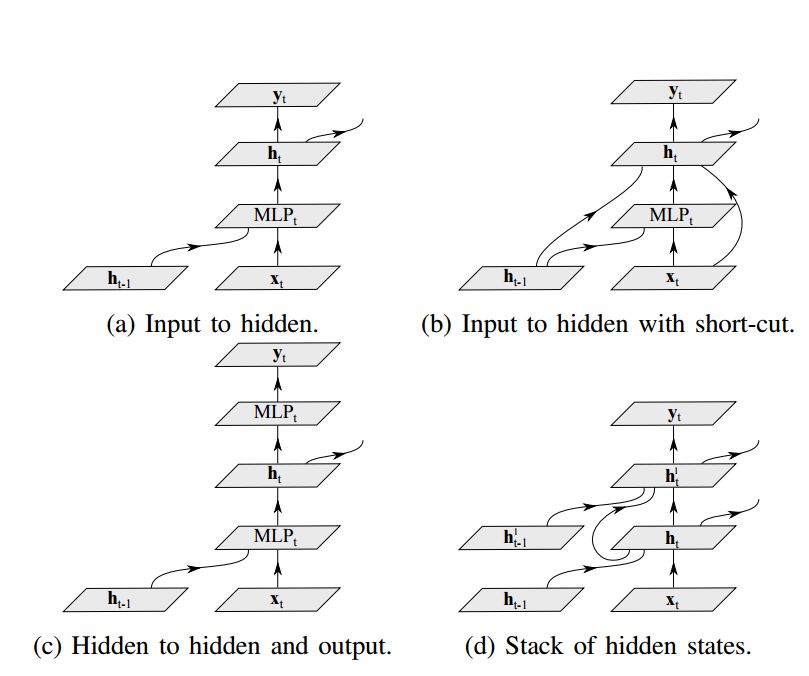

神经网络的深层架构相比浅层架构可以指数量级高效地表征函数。虽然由于每个隐藏状态都是所有过去隐藏状态的函数,使得循环神经网络在时间上就是内在的深度网络,但是人们已证明其内在运算实际上是很浅层的 [44]。在文献 [44] 中表明,在 RNN 的转换阶段添加一个或多个非线性层可以更好地理解初始输入的潜在变化,从而提升网络的整体性能。结合了感知机层的 RNN 的深度结构可以分成三类:输入到隐藏、隐藏到隐藏,以及隐藏到输出 [44]。

图 5:几种结合多层感知机的深度循环神经网络的架构。

(1)深度输入到隐藏:其基本思想之一是将多层感知机(MLP)结构引入转换和输出阶段,分别称为深度转换 RNN 和深度输出 RNN。

(2)深度隐藏到隐藏和输出:深度 RNN 重点关注于隐藏层的构造。在隐藏层中,来自过去数据抽象和新输入的数据抽象与/或隐藏状态结构都是高度非线性的。

(3)隐藏状态的堆叠:另一种构造深度 RNN 的方法是如图 5d 所示的方式堆叠隐藏层。这种类型的循环结构可以使网络在不同的时间尺度上工作,并允许网络处理多种时间尺度的输入序列 [44]。

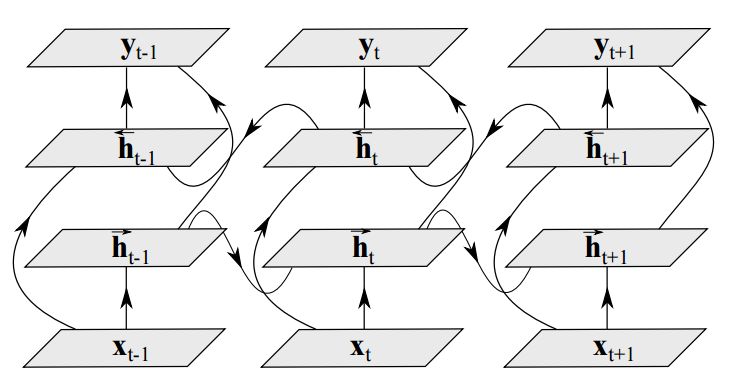

B. 双向 RNN(Bidirectional RNN)

传统的 RNN 在训练过程中只考虑数据的过去状态。虽然在很多应用中只考虑过去状态已经充分有效(例如语音识别),但是探索未来的状态也是很有用的 [43]。之前,人们尝试通过对输出延迟确定时间帧数,以在 RNN 的基础架构上利用未来状态作为当前预测的环境。然而,这种方法需要在所有的实现中手动优化延迟时间。而双向 RNN(BRNN)利用了过去和未来的所有可用输入序列评估输出向量 [46]。其中,需要用一个 RNN 以正向时间方向处理从开始到结束的序列,以及用另一个 RNN 处理以反向时间方向处理从开始到结束的序列,如图 6 所示。

图 6:双向 RNN 按时间展开。

C. 循环卷积神经网络

然而,RNN 中仍然缺乏在多个维度对上下文依赖关系的理解。其中最流行的网络架构使用了卷积神经网络(CNN)解决这些问题。

将循环连接整合到每个卷积层中,可以构成循环卷积神经网络(RCNN)[47]。RCNN 单元的激活值依赖于近邻的单元而随时间变化。这种方法可以整合上下文信息,对于目标识别任务很重要。这种方法可以增加模型的深度,而参数数量通过层间的权重共享保持不变。使用从隐藏层中从输出到输入的循环连接使网络可以建模标签依赖关系,并基于它的过去输出平滑输出 [48]。这种 RCNN 方法可以将大量输入上下文馈送到网络中去,同时限制模型的容量。这个系统可以用较低的推理成本建模复杂的空间依赖关系。

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-58506-3.html

-

-

朱永尚

朱永尚我也会多多的来关注这个变化的

-

布拉哈姆

布拉哈姆眼神很棒

apache 配置这篇文章介绍怎样用web服务器列出指定的目

apache 配置这篇文章介绍怎样用web服务器列出指定的目 服务器安全防护软件 Exim邮件服务器漏洞安全预警再升级 御界系统全面护航企业安

服务器安全防护软件 Exim邮件服务器漏洞安全预警再升级 御界系统全面护航企业安 国外学术界典型品牌价值评价体系的比较研究

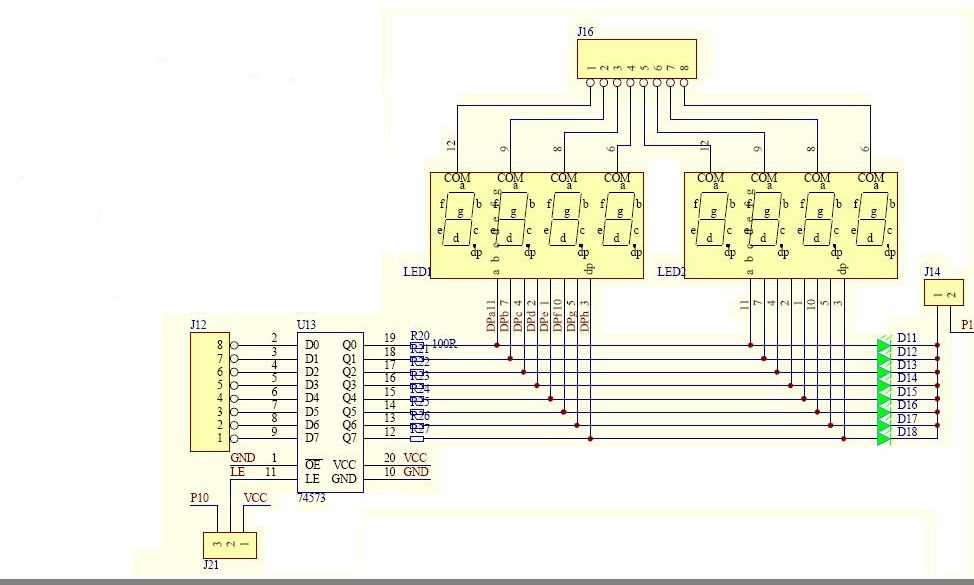

国外学术界典型品牌价值评价体系的比较研究 数字钟电路设计_数字钟电路板_数字钟电路原理图

数字钟电路设计_数字钟电路板_数字钟电路原理图

如果我们有10艘这样的阿利伯克宙斯盾