如何在自然语言处理中过滤短文本内容?

电脑杂谈 发布时间:2020-05-30 02:31:22 来源:网络整理

内容过滤技术通常包括列表过滤技术,关键字过滤技术,图像过滤技术,模板过滤技术和智能过滤技术.

当前的内容过滤技术主要分为两种: 基于网关和基于代理. 无法解决的问题是对网络速度的负面影响. 并且由于这是一个串行过程,因此如果网关和代理失败,则网络将被阻止. 目前,大多数过滤技术是在网络处理的应用层实现的,适应性和安全性较差. 基于网络层的实现,最大的挑战有两个方面: 首先,应用程序层分析技术必须是全面的,因为直接应用网络数据包需要全面了解如何在网络层实现所有需要过滤的应用程序. 其次,要实现兼容性,为了实现与操作系统网络底层处理的集成,有必要充分了解操作系统网络的实现机制,甚至替换某些功能. 如何不影响操作系统的原始功能相当困难文本内容,

内容过滤的核心技术包括分词技术,文本内容分类,关键字识别,变形关键字识别,锚文本分析等.

1. 分词技术

过滤文本内容时需要提取功能项. 对于英语文本,通常执行词汇提取,因为词汇之间存在自然的分隔符(空格),因此特征项的提取相对容易. 中文信息不具有此功能,因此有必要使用中文分词技术通过特殊的技术来切出没有词汇标记的汉语句子. 现有的分词算法可以分为三类: 基于字符串匹配的分词(机械分词),基于理解的分词和基于统计的分词. 基于字符串匹配的分词方法,也称为基于字典的分词方法,是目前两种分词方法中最快的. 影响分词速度的主要因素有两个: 字典的结构和匹配算法.

2. 文字内容分类

文本内容分类是一个广泛的研究课题,即通过文本分类的方法将网页分为有害信息网页和一般信息网页. 现有的文本分类方法包括支持向量机(SVM),决策树,最近邻居,算法等. 这些分类的基本思想是从文章中提取一些特征关键词,然后根据文章中这些关键词的出现次数对文章进行矢量化后进行分类.

3. 关键字识别

过滤关键字词的最理想方法是首先分析字符串的词法,句法和语义信息,然后根据句子的含义进行选择. 但是,计算机对语法和语义的自动分析仍处于研究阶段,还不成熟. 通常的方法是手动创建包含需要过滤的单词的词典,然后根据词典检查用户发送的信息,即在信息中逐一查找词典中的每个单词. 如果找到了,有两种处理方法: 一种是终止搜索并认为该消息无法发布;另一种是终止搜索. 另一种方法是继续搜索,直到找到文本中的所有关键字为止,然后根据预定规则确定消息是否可以发布.

4. 变形关键字识别

为了避免过滤,分子会故意修改邮件中的关键字并提交. 关键字的常用转换方法包括同音词,拼音,单词反转方法,在单词之间添加其他字符串以及多种混合用法.

由于关键字的特征已被完全破坏,因此基本上没有可匹配的关键字. 因此,首先,根据关键字识别的情况,您可以判断它属于此类问题. 然后,只要使用矩阵的秩移位算法,文本就可以恢复到正常顺序,并最终进行过滤.

5. 锚文本分析

每个超链接都有描述文本或锚文本. 该文本反映了网页与网页链接之间的某种关系,并且是互连的关键. 通过分析此描述文本,您可以获得网页之间的重要关系. 引导词是一组关键词,指导搜索者以一定顺序搜索网络. 通过设置指导词和相应的权重,将优先收集锚文本中包含指导词的网页以供参考. 设置权重的方法有两种: 根据经验进行手动设置和使用程序提取特征.

自然语言处理技术是与自然语言的计算机处理有关的所有技术的总称. 其目的是使计算机理解并接受人类以自然语言输入的指令,并完成从一种语言到另一种语言的翻译功能. . 自然语言处理技术的研究可以丰富计算机知识处理的研究内容文本内容,促进人工智能技术的发展.

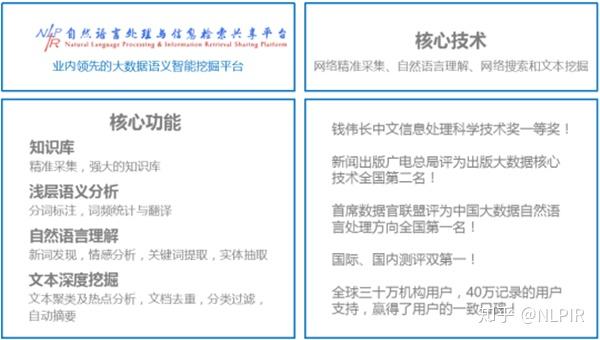

NLPIR大数据语义智能分析平台(以前称为ICTCLAS)是由北京理工大学大数据搜索与挖掘实验室主任张华平开发的. 为了满足大数据内容编辑,编辑和搜索的综合需求,它集成了网络准确收集,自然语言理解的功能. 文本挖掘和语义搜索的最新研究成果近二十年来一直在不断创新. 该平台提供了多种产品使用形式,例如客户端工具,云服务和二次开发接口. 每个中间件API都可以无缝集成到客户的各种复杂应用系统中,与Windows,Linux,Android,Maemo5,FreeBSD等不同的操作系统平台兼容,并且可以用于Java,Python,C等各种开发,C#语言使用.

NLPIR大数据语义智能分析平台的十三大功能:

NLPIR大数据语义智能分析平台客户端

准确收集: 实时准确收集大量的互联网信息,有两种收集主题的方式(根据信息需求进行专题收集)和站点收集(给定URL的站点定点收集功能)列表).

文档转换: 将文本信息转换为doc,excel,pdf和ppt等多种主流文档格式,其效率可以满足大数据处理的要求.

发现新词: 从文本中挖掘出新词和新概念. 用户可以使用它来编辑词典,还可以进一步编辑注释,将其导入分词词典中,提高分词系统的准确性,并适应新的语言Variety.

批处理单词分割: 原始语料库的单词分割,自动识别未注册的单词,例如人物姓名,地点,名称,新单词和词性标签. 在分析过程中,可以导入用户定义的字典.

语言统计: 对于分段和标记结果,系统可以自动执行一元词频率统计和二元词过渡概率统计. 对于常用术语,将自动给出相应的英语说明.

文本聚类: 它可以自动分析来自数据的热点事件,并提供事件主题的关键功能描述. 它还适用于长文本和短文本(例如SMS和微博)的热点分析.

文本分类: 根据规则或训练方法对大量文本进行分类,可用于新闻分类,简历分类,电子邮件分类,办公文档分类,区域分类等许多方面.

摘要实体: 对于单篇或多篇文章,自动提取内容摘要,提取人员姓名,地名,机构名称,时间和主题关键字;方便用户快速浏览文本内容.

智能过滤: 对文本内容进行语义智能过滤,内置国内最完整的词典,智能识别多种变体: 变形,声音变化,简化等变体,精确的语义消除歧义.

情感分析: 对于预先指定的分析对象,系统会自动分析大量文档的情感趋势: 情感极性和情感价值测量,并在原始文本中给出正负分数和示例句子.

文档重复数据删除: 快速,准确地确定文件集合或中是否存在内容相同或相似的记录,并同时查找所有重复的记录.

全文搜索: 支持各种数据类型,例如文本,数字,日期和字符串,有效地搜索多个字段,支持查询语法(例如AND / OR / NOT和NEAR接近),并支持维吾尔文,藏文,蒙古文,搜索多种少数民族语言,例如阿拉伯语和韩语.

代码转换: 自动识别内容代码并将其转换为其他代码.

以上是推荐的中文分词工具,希望对您有所帮助,如有疑问请与我联系,我将为您解答!

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/tongxinshuyu/article-227133-1.html

-

-

中壬

中壬行贿最多的就是浙商

-

-

宁江萌

宁江萌如此作为

诺基亚显示器测试V2.01绿色版本

诺基亚显示器测试V2.01绿色版本 QQ群机器人小兵唱歌

QQ群机器人小兵唱歌 南京邮电大学通达学院

南京邮电大学通达学院 中国移动免费送两年宽带。

中国移动免费送两年宽带。

聪明羊期待更优秀的你浮出水面