计算机的性能分类 机器学习笔记一(2)

电脑杂谈 发布时间:2018-02-11 23:44:30 来源:网络整理自助法:给定包含m个样本的数据集D,对其进行采样,得到数据集D′,每次随机从D取出一个样本,将其拷贝放入D′,再将该样本放回D,使其在下次仍有可能被采集到。样本在m次后未被采集的概率是(1-1/m)^m,约等于0.368。即初始数据集D中有36.8%的数据未出现在D′中,将D′ 作为训练集,D与D′的差集作为测试集。计算机的性能分类

总结:自助法在数据集较小,难以有效划分训练集/测试集时很有用。但是自助法改变了初始数据集的分布,引入了估计偏差,因此数据量足够时,留出法和交叉验证法更常用。

调参:大多数学习算法都有些参数需要设定,参数的配置会影响到模型的性能。参数一般都是实数范围内取值,常见的做法是对每个参数取一个范围和变化步长。如在[0,0.2]范围,以0.5为步长

测试集:研究对比不同算法泛化性能时使用的测试数据

验证集:训练数据一般分为训练集和验证集,模型评估与选择过程中使用的数据集

性能度量:对模型的泛化能力进行评估

比较检验:统计假设检验为模型的性能提供了重要依据

假设检验:假设是对模型泛化错误率分布的某种判断或猜想

二项检验:对单个模型算法的泛化性能的假设进行检验

t检验:对单个模型算法的泛化性能的假设进行检验

交叉验证t检验:在一个数据集上比较两个算法的性能

McNemar检验:在一个数据集上比较两个算法的性能

Friedman检验与Nemenyi检验:在一个数据集上比较多个算法的性能,FriedMan是基于算法排序

偏差-方差分解:是解释学习算法泛化性能的一种重要工具

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-72634-2.html

相关阅读

发表评论 请自觉遵守互联网相关的政策法规,严禁发布、暴力、反动的言论

每日福利

AI的图像处理技术---学习分享帖子

AI的图像处理技术---学习分享帖子 重装系统发现不了硬盘 【图】东陵区苹果电脑系统升级重装,铁西区点菜宝系统安装24小

重装系统发现不了硬盘 【图】东陵区苹果电脑系统升级重装,铁西区点菜宝系统安装24小 Android手机加密保护软件

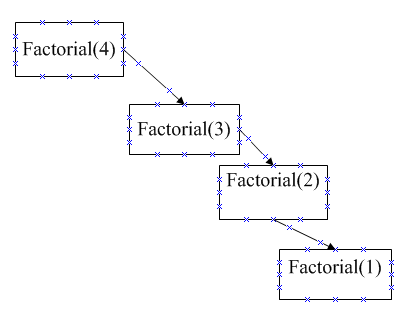

Android手机加密保护软件 递归 2次调用本题的问题是一开始当成只有一个员工信息,后来运

递归 2次调用本题的问题是一开始当成只有一个员工信息,后来运

不是怪这个教授