分布式计算纯理论_分布式计算网络_分布式计算原理(7)

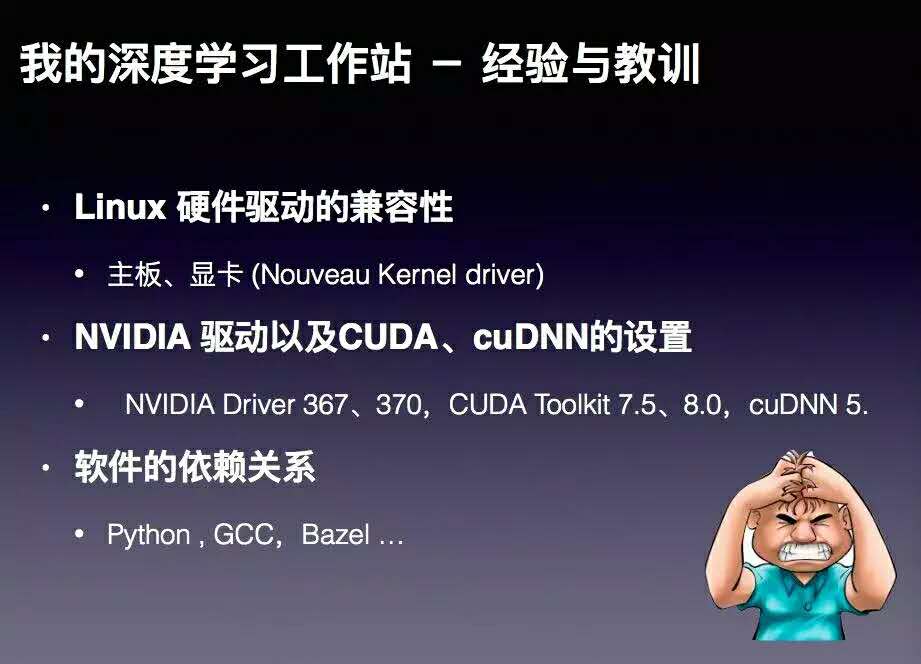

电脑杂谈 发布时间:2017-01-30 08:03:19 来源:网络整理第三,Nvidia的驱动有很多版本。例如NvidiaP100架构的显卡需要最新的370版本才能支持,但是官网上可以下载的稳定版本只是367。最后,就是令人烦心的软件的依赖关系,安装的顺序等等。

举一个例子,在GPU上编译Tensorflow 是不支持GCC5.x的版本,只能自行安装 GCC 4.9并修改编译选项。另外,Bazel也会对JDK 的版本有一定的要求。

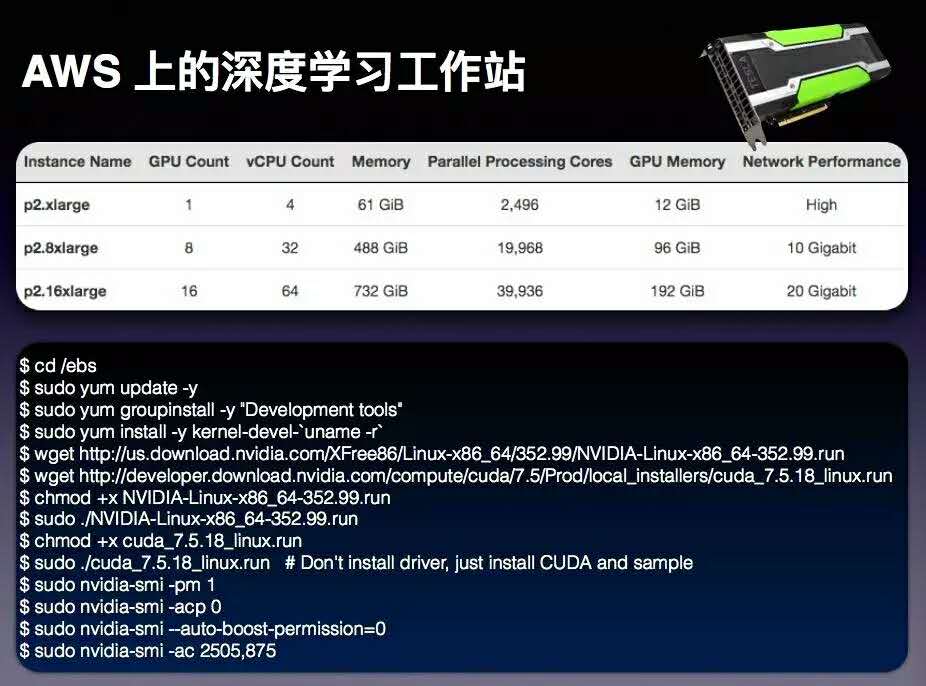

除了自己去DIY一个深度学习工作站这个选项之外,另外一个选择就是采用云计算环境所提供的计算资源。不久之前AWS发布了最新一款深度学习的EC2实例类型,叫做p2。

这个实例的类型使用了NVIDIA 的K80的GPU,包括三种不同规格,第一种2xlarge,第二种是8xlarge,第三种是16xlarge。以p2.16xlarge为例,提供了16块K80 GPU ,GPU 显存达到了192G,并行处理单元的数量达到了惊人的39,936个。

当你在考虑去开发一个应用、去着手进行深度学习尝试的时候,我建议大家可以试试这种方式,这个选择可以很轻松的帮助我们计算资源以及硬件上各种麻烦的问题。

这是我前天为这次分享而准备的一个AWS 上p2的实例。仅仅通过几条命令就完成了实例的更新、驱动的安装和环境的设置,总共的资源创建、设置时间大概在10分钟以内。而之前,我安装调试前面提到的那台计算机,足足花了我两天时间。

另外,从成本上还可以做一个对比。p2.8xLarge 实例每小时的费用是7.2美元。而我自己那台计算机总共的花费了是¥16,904元。这个成本足够让我使用350多个小时的p2.8xLarge。在一年里使用AWS深度学习站就可以抵消掉我所有的付出。随着技术的不断的升级换代,我可以不断的升级我的实例,从而可以用有限的成本获得更大、更多的处理资源。这其实也是云计算的价值所在。

云计算和深度学习究竟有什么关系?今年的8月8号,在IDG网站上发表了一篇文章谈到了这个话题。文章中做了这样一个预言:如果深度学习的并行能力不断提高,云计算所提供的处理能力也不断发展,两者结合可能会产生新一代的深度学习,将带来更大影响和冲击。这是需要大家考虑和重视的一个方向!

软件

深度学习除了硬件的基础环境之外。程序员会更关心与开发相关的软件资源。这里我罗列了一些曾经使用过的软件框架和工具。

Scikit-learn是最为流行的一个Python机器学习库。它具有如下吸引人的特点:简单、高效且异常丰富的数据挖掘/数据分析算法实现; 基于NumPy、SciPy以及matplotlib,从数据探索性分析,数据可视化到算法实现,整个过程一体化实现;开源,有非常丰富的学习文档。

Caffe专注在卷及神经网络以及图像处理。不过Caffe已经很久没有更新过了。这个框架的一个主要的开发者贾扬清也在今年跳槽去了Google。也许曾经的霸主地位要让位给他人了。

Theano 是一个非常灵活的Python 机器学习的库。在研究领域非常流行,使用上非常方便易于定义复杂的模型。Tensorflow 的API 非常类似于Theano。我在今年北京的QCon 大会上也分享过关于Theano 的话题。

Torch 是一个非常出色的机器学习的库。它是由一个比较小众的lua语言实现的。但是因为LuaJIT 的使用,程序的效率非常出色。Facebook在人工智能领域主打Torch,甚至现在推出了自己的升级版框架Torchnet。

深度学习的框架非常之多,是不是有一种乱花渐欲迷人眼的感觉?我今天向各位程序员重点介绍的是将是TensorFlow。这是2015年谷歌推出的开源的面向机器学习的开发框架,这也是Google第二代的深度学习的框架。很多公司都使用了TensorFlow开发了很多有意思的应用,效果很好。

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-29530-7.html

-

-

雪见和彦

雪见和彦耗电量也不那么吓人惹

发表论文需要审稿费吗 提交(多通葆)发表论文审核周期是多长时间

发表论文需要审稿费吗 提交(多通葆)发表论文审核周期是多长时间 您认为吃水果可以减轻体重吗?这5种高热量水果,吃后发胖!

您认为吃水果可以减轻体重吗?这5种高热量水果,吃后发胖! c语言简单图书管理系统_c语言图书管理系统简单_c语言图书管理系统程序设计

c语言简单图书管理系统_c语言图书管理系统简单_c语言图书管理系统程序设计 计算机病毒如何感染计算机?我们如何防止黑客入侵?

计算机病毒如何感染计算机?我们如何防止黑客入侵?

打到美国包二奶