深度学习技术使防人脸识别技术与人脸识别技术的人工智能算法相互对抗

电脑杂谈 发布时间:2020-04-20 21:14:32 来源:网络整理

多伦多大学的研究人员设计了新算法,通过动态干扰人脸识别工具来保护用户隐私. 结果表明,他们的系统可以将最初可检测到的面部比例从接近100%降低到0.5%.

在某些社交媒体平台上,每次您上传照片或视频时,其面部识别系统都会尝试从这些照片和视频中获取更多信息. 例如,这些算法将提取有关您的身份,位置和认识的其他人的数据,并且这些算法正在不断完善.

现在,面部识别的突破者“反面部识别”问世了.

Parham Aarabi教授和多伦多大学Avishek Bose的团队开发了一种可以动态破坏人脸识别系统的算法.

他们的解决方案使用一种称为对抗训练的深度学习技术,该技术允许两种人工智能算法相互抗争.

现在,深度神经网络已应用于各种问题,例如自动驾驶汽车,癌症检测等,但是我们迫切需要更好地了解这些模型如何容易受到攻击. 在图像识别领域,对图像添加较小的,通常无法察觉的干扰可能会欺骗典型的分类网络,从而对图像进行错误地分类.

被扰动的图像称为对抗示例,它们可用于在网络上进行对抗攻击. 已经有几种制造对抗性样本的方法. 它们在被攻击模型所需的复杂性,计算成本和访问级别方面差异很大.

通常来说,对抗攻击可以根据攻击模型的访问级别和对抗目标进行分类. 白盒攻击可以完全访问所攻击模型的结构和参数. 黑匣子攻击只能访问被攻击模型的输出.

一种基线方法是快速梯度符号方法(FGSM),该方法根据输入图像的梯度来攻击分类器的损失. FGSM是白盒方法,因为它需要访问被攻击分类器的内部. 有多种强大的攻击深度神经网络的方法可以攻击图像分类,例如L-BFGS,基于基于acobian的显着性图攻击(JSMA),DeepFool和carlin-wagner. 但是,这些方法涉及对可能的干扰空间进行复杂的优化人脸检测技术经典算法,这使其速度慢且计算量大.

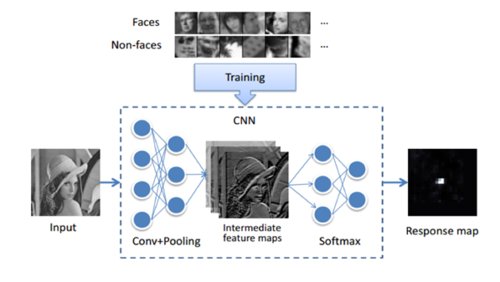

与攻击分类模型相比,用于攻击目标检测的管道要困难得多. 最先进的检测器,例如Faster R-CNN,使用不同比例和位置的对象方案,然后对其进行分类. 目标数量比分类模型大几个数量级.

此外,如果受攻击的方案只是总数的一小部分,那么仍然可以通过不同的方案子集正确检测受干扰的图像. 因此,成功的攻击需要同时欺骗所有对象方案.

在这种情况下,研究人员证明可以快速攻击最先进的面部检测器.

研究人员已经开发了一种“隐私过滤器”,该过滤器可能会干扰面部识别算法. 该系统依靠两种AI算法: 一种执行连续的面部检测,另一种旨在销毁前者.

研究人员提出了一种基于Faster R-CNN的面部检测器攻击新方法. 此方法会产生较小的干扰(扰动). 将这些干扰添加到输入的面部图像时,将导致预训练的面部检测器发生故障.

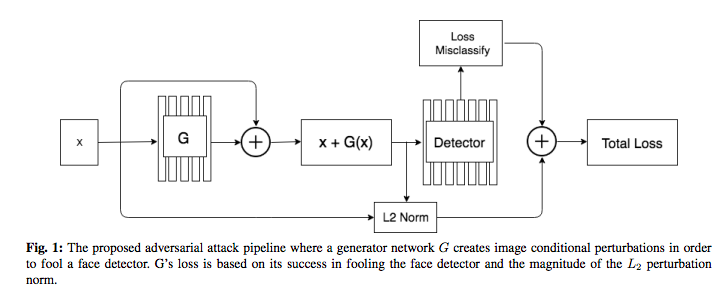

为了产生对策干扰,研究人员提议基于预训练的Faster R-CNN人脸检测器训练发电机. 给定图像,发生器将产生较小的干扰,可以将其添加到图像中以欺骗面部检测器. 人脸检测器仅对未受干扰的图像进行离线训练,因此不知道的存在.

随着时间的流逝,发生器已经学会产生干扰,可以有效地欺骗其训练的面部检测器. 生成对抗性样本非常快速且成本低,甚至比FGSM还要低,因为对输入产生干扰仅需对进行充分训练后就可以向前通过.

两个神经网络相互面对,形成一个“隐私”过滤器

研究人员设计了两个神经网络: 第一个用于识别人脸,第二个用于干扰第一个神经网络的人脸识别任务. 这两个神经网络不断地相互面对并相互学习.

结果是一个类似于instagram的“隐私”过滤器,可以将其应用于照片以保护隐私. 秘密在于,他们的算法会更改照片中的某些特定像素,但人眼几乎看不到这些更改.

“干扰AI算法无法'攻击'用于检测面部的神经网络正在寻找的东西. ”该项目的主要作者玻色(Bose)说: “例如,如果检测网络正在寻找眼角,则干扰算法将调整. 眼角会使眼角中的像素不那么明显. 该算法对照片造成很小的干扰,但是对于检测器而言,这些干扰足以欺骗系统. ”

算法1: 针对的培训

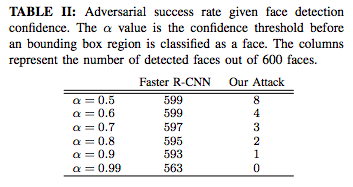

在人脸检测具有信心的情况下,对抗的成功率. α值是在将边界框区域分类为人脸之前的置信度阈值. 右侧的两列表示在600张照片中检测到的脸部数量.

研究人员在300 W面部数据集上测试了他们的系统,该数据集包含600多种不同种族,不同照明条件和背景环境的面部照片,并且是行业标准库. 结果表明人脸检测技术经典算法,他们的系统可以将最初可检测到的面部比例从接近100%降低到0.5%.

拟议的对抗攻击的松线,其中网络G产生图像条件干扰以欺骗人脸检测器.

Bose说: “这里的关键是训练两个神经网络互相对抗,一个创建一个功能越来越强大的面部检测系统,另一个创建一个功能更强大的禁用面部检测的工具. 该小组的研究将在即将举行的2018 IEEE国际多媒体信号处理研讨会上发表.

将300-W数据集的面部检测与相应的对抗性样本进行比较,这些样本产生了干扰,并且未被Faster R-CNN面部检测器检测到. 所检测到的人脸被包围在具有相应置信度值的边界框中. 为了可视化,将干扰放大了10倍.

除了禁用面部识别之外,这项新技术还可以干扰基于图像的搜索,特征识别,情感和种族判断以及其他可以自动提取面部属性的特征.

接下来,该小组希望通过该应用或网站公开此隐私过滤器.

“十年前,这些算法必须由人类来定义,但是现在神经网络可以自己学习,除了训练数据,您不需要为其提供任何其他信息,” Aarabi说. “最终,他们可以做一些非常出色的事情,并具有巨大的潜力. ”

原标题: [人脸识别终结者]多伦多大学反人脸识别,身份欺诈成功率达到99.5%

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-182809-1.html

-

-

王平子

王平子妓者就是为了点击率和稿费

-

神保直美

神保直美我咋感觉现在台湾是个诱饵呢

三维网草种植施工技术方案

三维网草种植施工技术方案 Tomato Garden Win10 x86(1909 Professional Edition)v2020.06

Tomato Garden Win10 x86(1909 Professional Edition)v2020.06 c语言程序设计课程设计 图书管理系统 求原代码

c语言程序设计课程设计 图书管理系统 求原代码 苹果电脑能装win10系统吗?windows系统的方法

苹果电脑能装win10系统吗?windows系统的方法

国家连年扩招