中国艺术研究院好考吗_amd中国研究院_中国鼻科研究院在哪里(7)

电脑杂谈 发布时间:2017-02-22 01:04:14 来源:网络整理谷俊丽:预处理包括:图像截取,移位,不同图像打成batch一起处理

新疆武新: 关于非标签的DNN,比如那个Google 猫的案例,我怎么感觉这是个鸡和蛋的问题。 如果我们没有给系统提供任何关于猫的定义或描述,系统即便能识别出猫这个形状,怎么可能告诉我们这是猫哪? 就像个小孩子,从来没见过猫,也没人告诉他猫是什么样,有一天他见到一个猫,是没有办法从嘴里说出这是猫的。

谷俊丽:是google研究员在分析机器学习出来的特征时,看到了有神经元识别出来的是猫脸。

huailin:弱弱问一个问题:您是系统/体系结构背景,还是AI/图像的? 懂的真多。真心佩服。

谷俊丽:@新疆武新,您这个问题其实非常sharp,一个好的神经网络训练完之后,不同的神经元代表不一样的特征,比如有的对猫脸,有的对人脸,有的对人的背影。

尚硕:请问dnn中mlp、卷积等目前有比较系统化的应用方向么?

俊丽:

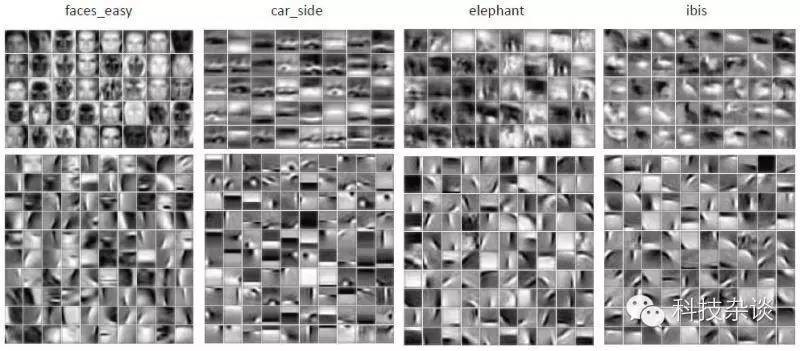

大家看看这张图片,就是学习出来的不同物体的特征,有人脸,汽车,大象等

俊丽:MLP应用比较广泛,语音识别用的就是它;图像识别主要用卷积神经网络

武新 :我好像明白了:要先有一个训练后能识别锚脸的神经元网络,然后用它去识别具体图像,不断迭代下去,识别会越来越精准。是这样吧?

谷俊丽: 应该这么理解,神经网络学习到的是一堆各种各样的特征,有的物体可能一个特征能够描述,有的需要不同特征组合起来能够描述;输入的图像总类越多呢,网络越能知道什么物体需要什么特征组合来描述。

谷俊丽:再多说一句,现在的图像识别能分类两万多种物体。现实世界的常见物体都能识别了

董振江: 类似于找最大公约数

Brain Lai:今天的课题太有意义了对大数据 感谢@junli

陈新河:今天技术够深,把群中搞技术的都唤醒了

彭永辉 :MLP有overfit 问题,卷机网络学动态数据好。NN对输入敏感,所以预处理部分的作用异常重要。

俊丽:一个主流模型可能有十亿个参数,可以表达很多物体的,因为里面可能有亿亿个神经元,各种互联

卿刚:APU的物理尺寸如何?集群上的并行计算编程环境易用吗?@AMD谷俊丽?

谷俊丽: 现在的APU跟传统的CPU大小一样,看不出来区别;以后未必;编程环境用的是OpenCL,AMD的GPU和APU都用OpenCL,OpenCL可以运行在多种异构平台上,多家公司都在支持OpenCL,NVidia平台上也可以运行,亿亿的神经元,具体数目可能不准确,但是人类大脑神经元数目远比我们现在的深度神经网络要大的多,所以才有强大的学习能力,推理\归纳能力。

新疆武新: OpenCL 可以和C/C 混搭使用吗? 是不同的进程空间吧?

谷俊丽:OpenCL可以混合C、C++

Brian Lai: @junli 是不是一种类别,就需要一个neural network 模型呢?还是都放在一起?

谷俊丽:都在一个模型中

YH@Peng: MLP有overfit 问题,卷机网络学动态数据好。NN对输入敏感,所以预处理部分的作用异常重要

卿刚:感觉Nvidia这类公司,可能要重金请你,因为技术创新可能省掉一张卡呀,说笑说笑,2者今后可能即有竞争也有补充

谷俊丽:谢谢@Q.G肯定

Brian Lai:@junli 如果weight 的表达是[0,1] , 粒度变的无限细的时候,那么控制的学习的算法是不是需要混合的呀?

谷俊丽:@回到北京-Brian Lai,不太明白您的问题,weight一般是浮点型数据。每次学习调整的幅度很小,比如0.1%的幅度

Brian Lai:@junli 感谢今晚的精彩分享!

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/dianqi/article-33771-7.html

-

-

钱建江

钱建江TaobabyPanda

-

希腊中央空调面板符号说明

希腊中央空调面板符号说明 湖北氟塑料热交换器创下新纪录

湖北氟塑料热交换器创下新纪录 好家档橱柜_大自然橱柜官网_蒂乐橱柜

好家档橱柜_大自然橱柜官网_蒂乐橱柜 3台HP机柜式空调性价比高吗?

3台HP机柜式空调性价比高吗?

整个华夏世代受制于人