stagefright框架_stagefright下载_stagefright是什么(2)

电脑杂谈 发布时间:2017-05-31 00:03:00 来源:网络整理

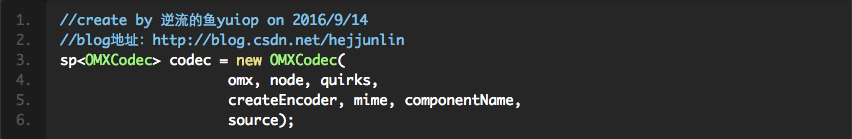

这样就得到了OMXCodec。

AwesomePlayer中得到这个OMXCodec后,接着看initVideoDecoder/initAudioDecoder,这里看initAudioDecoder方法,是把 mAudioSource = mOmxSource,赋值,接着调用mAudioSource->start()进行初始化。 OMXCodec初始化主要是做两件事:

向OpenMAX发送开始命令。mOMX->sendCommand(mNode, OMX_CommandStateSet, OMX_StateIdle)

调用allocateBuffers()分配两个缓冲区,存放在Vector mPortBuffers[2]中,分别用于输入和输出。

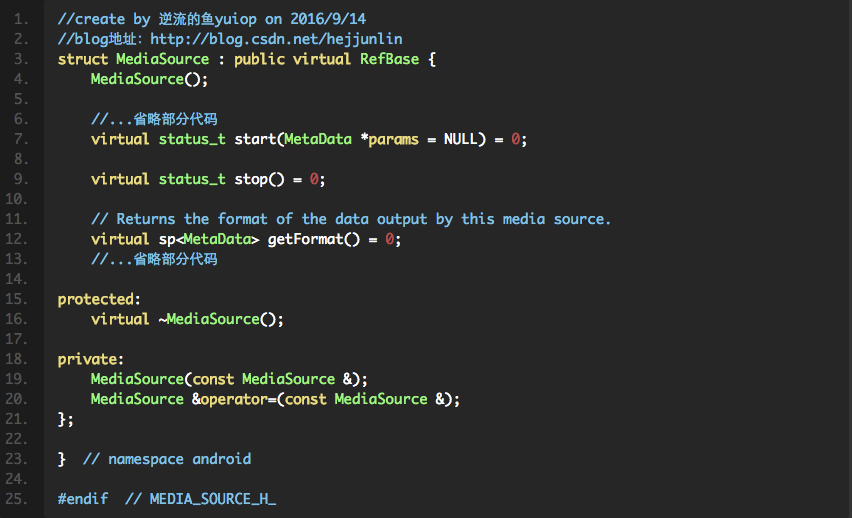

然后在现个initxxxDecoder方法中会调用(mAudioSource->start()/mVideoSource->start())

触发MediaSource的子类VideoSource及AudioSource调用start()方法后,它的内部就会开始从数据源获取数据并解析,等到缓冲区满后便停止。在AwesomePlayer里就可以调用MediaSource的read方法读取解码后的数据。

对于mVideoSource来说,读取的数据:mVideoSource->read(&mVideoBuffer, &options)交给显示模块进行渲染,mVideoRenderer->render(mVideoBuffer);

对mAudioSource来说,用mAudioPlayer对mAudioSource进行封装,然后由mAudioPlayer负责读取数据和播放控制。

AwesomePlayer调用OMXCode读取ES数据,并且进行解码的处理

OMXCodec调用MediaSource的read函数来获取音视频的数据

OMXCodec调用Android的IOMX接口,其实就是Stagefrightdecode中的 OMX实现

本文出自逆流的鱼:

这个过程就是prepare的过程,重点是解码把流放到Buffer中

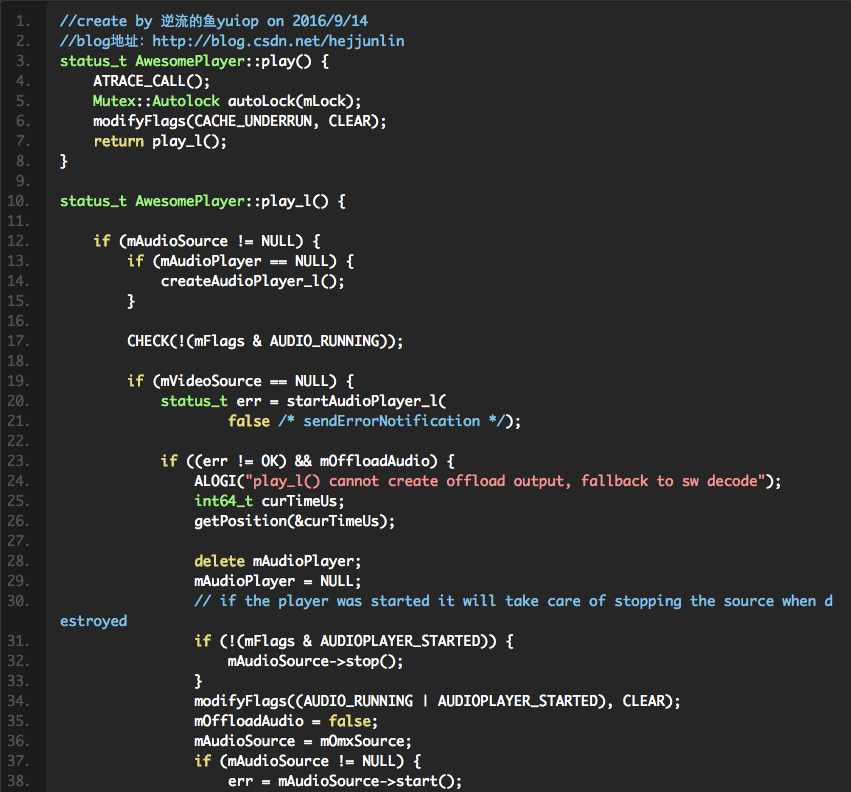

接下来,当java层调用start方法时,通过mediaplayerservice,再传到StagefrightPlayer中,引用AwesomePlayer,这样就调到AwesomePlayer的play方法,看代码:

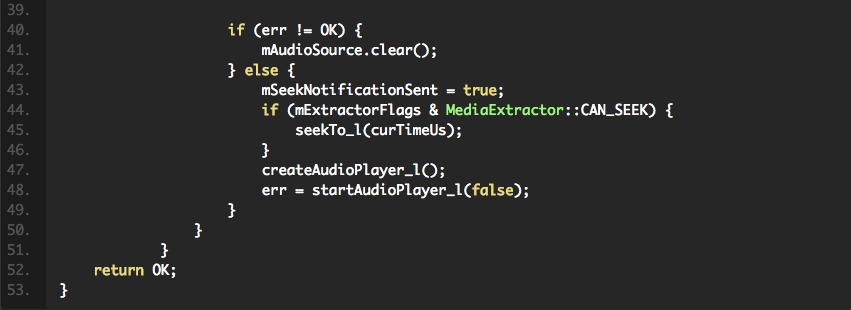

当AwesomePlayer调用play后,通过mVideoSource->read(&mVideoBuffer, &options)读取数据。mVideoSource->read(&mVideoBuffer, &options)具体是调用OMXCodec.read来读取数据。而OMXCodec.read主要分两步来实现数据的读取:

(1) 通过调用drainInputBuffers()对mPortBuffers[kPortIndexInput]进行填充,这一步完成 parse。由OpenMAX从数据源把demux后的数据读取到输入缓冲区,作为OpenMAX的输入。

(2) 通过fillOutputBuffers()对mPortBuffers[kPortIndexOutput]进行填充,这一步完成 decode。stagefright框架由OpenMAX对输入缓冲区中的数据进行解码,然后把解码后可以显示的视频数据输出到输出缓冲区。

AwesomePlayer通过mVideoRenderer->render(mVideoBuffer)对经过parse和decode 处理的数据进行渲染。一个mVideoRenderer其实就是一个包装了IOMXRenderer的AwesomeRemoteRenderer:

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/tongxinshuyu/article-50198-2.html

-

-

姜皎

姜皎不动武就惊跑了美帝

-

沈祖仙

沈祖仙美国得继续付出才行

上海市普陀区电子设备的销毁-不合格计算机配件的销毁处理

上海市普陀区电子设备的销毁-不合格计算机配件的销毁处理 有关电力谐波的论文的参考文献在哪里可以找到有关电力谐波的英语参考文献

有关电力谐波的论文的参考文献在哪里可以找到有关电力谐波的英语参考文献 如何为扫地机器人充电

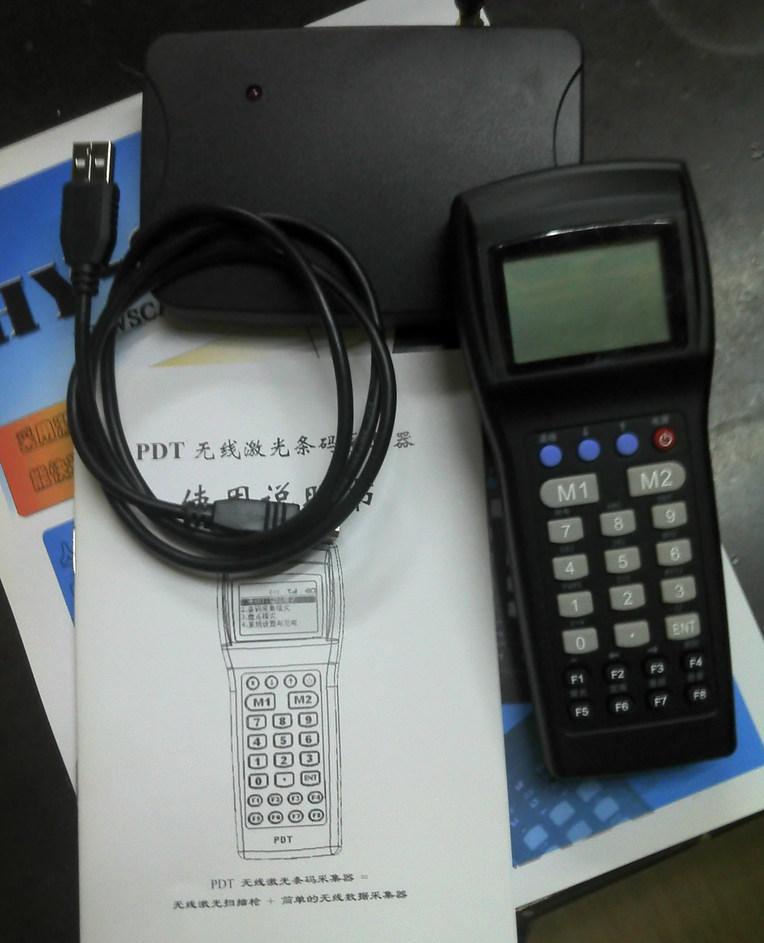

如何为扫地机器人充电 无线激光条码采集器_seuic 条码采集器_无线条码扫描器使用

无线激光条码采集器_seuic 条码采集器_无线条码扫描器使用

----