分布式计算python_经典分布式计算模型_并行分布式计算(9)

电脑杂谈 发布时间:2017-02-27 14:09:18 来源:网络整理切割大样本数据,并行化计算

在经典的统计估计中,我们处理的多半是大样本低维度的数据,现在则多是是大样本高维度的数据。对于经典的大样本低维度数据,如果机器不够好,那么就抽样部分数据亦可以实现较好估计,不过如果没有很好的信息,就是想要对大样本进行处理,那么切割数据,并行计算是一个好的选择。现在的社交网络、网络日志、无线感应网络等都可以这么实施。下面的具体模型都在受约束的凸优化问题中以及ℓ1-norm问题中提过,此处只不过切割数据,做成分布式模型,思想很简单,与带正则项的globalconsensus问题一样的处理。经典问题lasso、sparse logisticlasso、SVM都可以纳入如下框架处理。

有观测阵A∈Rm×n和响应值b∈Rm,可以对应切分,即对矩阵A和向量b横着切,

A=⎛⎝⎜⎜A1⋮AN⎞⎠⎟⎟b=⎛⎝⎜⎜b1⋮bN⎞⎠⎟⎟

于是原来带正则项的优化问题就可以按照数据分解到多个子系统上去分别优化,然后汇集起来,形成一个globalconsensus问题。

mins.t.∑i=1Nli(Aixi−bi)+r(z)xi−z=0,i=1,…,Nxi,z∈Rn

结合受约束的凸优化问题时所给出来的具体的ADMM算法解的形式,下面直接给出这些问题的ADMM迭代算法公式

(1)Lasso

xk+1izk+1uk+1i=(ATiAi+ρI)−1(ATibi+ρ(zk−uki))=S1/ρN(x¯k+1−b+u¯k)=uki+xk+1i−zk+1

如果切割的数据量小于维数mi

(2)Sparse Logistic Regression

xk+1izk+1uk+1i=argminxi(li(Aixi−bi)+(ρ/2)∥xi−zk+uki∥22=S1/ρN(x¯k+1−b¯+u¯k)=uki+xk+1i−zk+1

在x-update步是需要用一些有效的算法来解决ℓ2正则的logistic回归,比如L-BFGS,其他的优化算法应该问题不大吧。

(3)SVM

注意分类问题和回归问题的损失函数不同,一般都是用l(sign(t)y)形式来寻求最优的分类权重使得分类正确。SVM使用HingeLoss:ℓ(y)=max(0,1−t⋅y),即将预测类别与实际分类符号相反的损失给凸显出来。分布式的ADMM形式

xk+1izk+1uk+1i=argminxi(1T(Aixi+1)++(ρ/2)∥xi−zk+uki∥22=ρ(1/λ)+Nρ(x¯k+1+u¯k)=uki+xk+1i−zk+1

4.3 一般形式的一致性优化问题(切割参数到各子系统,但各子系统目标函数参数维度不同,可能部分重合)上述全局一致性优化问题,我们可以看到,所做的处理不过是对数据分块,然后并行化处理。经典分布式计算模型但是更一般的优化问题是,参数空间也是分块的,即每个子目标函数fi(xi)的参数维度不同xi,∈Rni,我们称之为局部变量。而局部变量所对应的的也将不再是全局变量z,而是全局变量中的一部分zg,并且不是像之前的顺序对应,而可能是随便对应到z的某个位置。可令g=G(i,⋅),即将xi映射到z的某部位

(xi)j=zG(i,j)=z^i

如果对所有i有G(i,j)=j,那么xi与z就是顺序映射,也就是全局一致性优化问题,否则就不是。结合下图就比较好理解

虽然如果用其他方法来做感觉会复杂,但是纳入到上述ADMM框架,其实只不过是全局一致性优化问题的一个局部化变形,不过此时不是对数据进行分块,是对参数空间进行分块

mins.t.∑i=1Nfi(xi)+g(z),xi∈Rnixi−z^i=0,i=1,…N⟹xk+1izk+1yk+1i=argminx(fi(xi)+(yki)Txi(ρ/2)∥xi−z^ki∥22))=argminz(∑i=1N(−(yki)Tz^i+(ρ/2)∥xk+1i−z^i∥22)))=yki+ρ(xk+1i−z^k+1i)

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/tongxinshuyu/article-34812-9.html

-

-

杨玢

杨玢想讹钱

本实用新型涉及液压设备技术领域的具体涉及一种油箱油位显示装置及液压系统

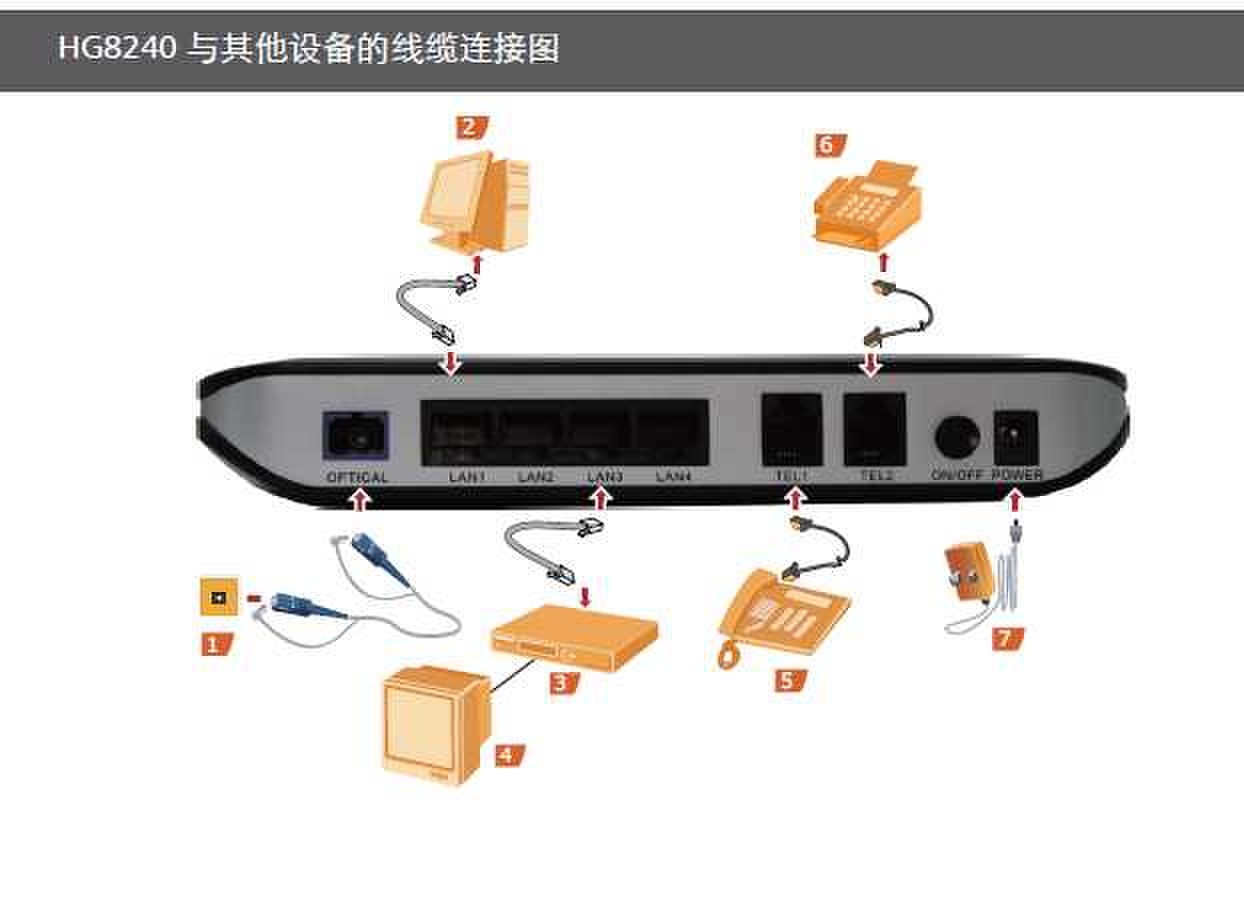

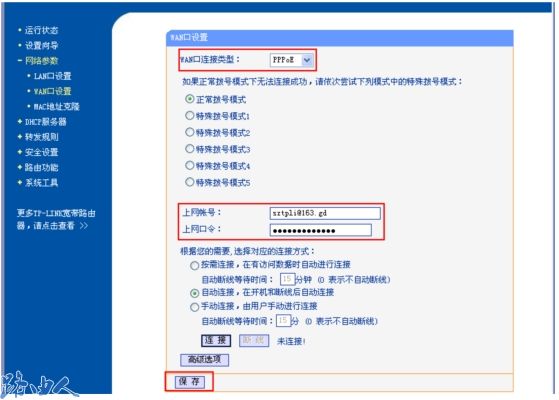

本实用新型涉及液压设备技术领域的具体涉及一种油箱油位显示装置及液压系统 hg8245 ippbx_hg8245设置_hg8245超级密码

hg8245 ippbx_hg8245设置_hg8245超级密码 安装并设置路由器后,计算机仍然无法访问Internet

安装并设置路由器后,计算机仍然无法访问Internet 温州移动营业厅二维码 移动携号转网办理营业厅全市仅三家

温州移动营业厅二维码 移动携号转网办理营业厅全市仅三家

我们的飞机相互之间确定位置的技术手段还主要依靠罗盘和地面指示