基于变异模型的移动机器人三维环境建模方法研究

电脑杂谈 发布时间:2020-05-13 02:13:46 来源:网络整理

【摘要】: 移动机器人使用自己的传感器对周围环境进行快速建模,并实现自主定位,行为计划和动态决策的关键任务. 这些是衡量移动机器人的智能感知能力的核心技术问题. 同步定位和地图(SLAM)是机器人技术领域的代表性研究热点之一. 在这项研究中,针对移动机器人的基于视觉的姿势估计和环境建模问题进行了研究. 首先,针对视觉定位过程中模型估计的鲁棒性问题,提出了一种改进的随机抽样一致性算法(IPGSAC). 其次,根据主动视觉传感器的特点,分别提出了基于稀疏图像特征匹配和混合模型的移动机器人姿态估计和地图创建算法. 受到以上算法的启发,提出了一种基于地面特征的移动机器人单目视觉里程计算方法. 并进一步使用改进的PTAM(并行跟踪和映射)算法来建立环境的三维稀疏特征图. 最后,在上述稀疏特征图的基础上,提出了一种基于视觉反馈的深度变化模型,以实现对环境的密集三维建模. 本文的具体研究内容如下: (1)对于现有的改进的RANSAC(Random Sample Consensus)算法,仅将迭代过程中的部分数据用于测试评估,导致算法的可靠性较差. 和其他问题. 算法.

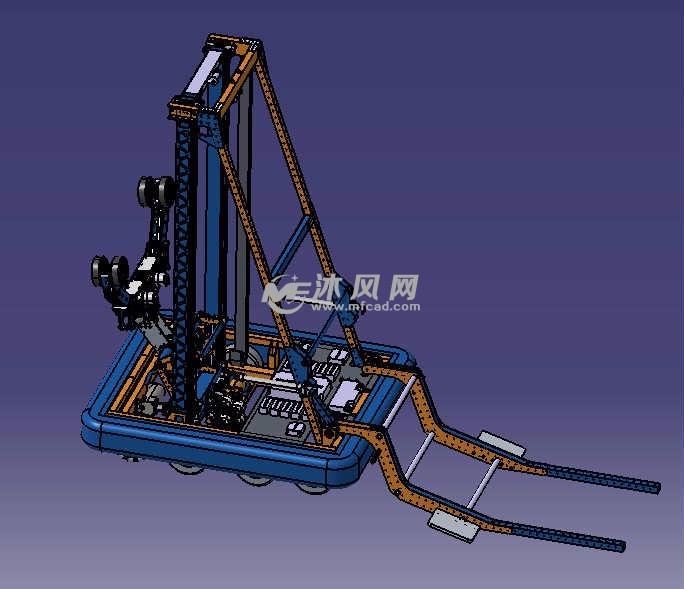

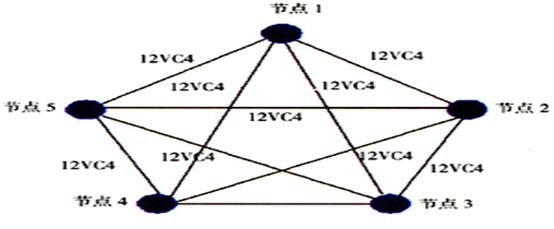

该算法使用混合概率分布来建立测试样本的初始概率估计. 通过将总概率公式和包含测试点的内部点的统计数据相结合,建立了测试样本的多源评估策略. DS(Dempster-Shafer)证据理论用于实现上述评估值的融合,并以更高的准确度获得测试样本评估. 同时,引入了遗忘理论,以消除迭代过程中错误判断信息的干扰,提高算法的可靠性. 最后,在建立概率估计的基础上,采用逆变器映射原理,增加了以较高概率对测试点进行采样的可能性,有效提高了算法的收敛速度. 实验结果表明,与标准的RANSAC,MSAC,NAPSAC和MLESAC算法相比,所提出的IPGSAC算法在收敛速度和准确性上都具有更大的优势. (2)针对主动视觉传感器可以直接获取环境深度信息的优点,提出了一种基于深度相机的移动相机同时定位和地图创建算法. 首先移动机器人建模,在地图创建过程中利用图像特征匹配获得数据关联,推导移动机器人姿态估计模型,提出的IPGSAC算法有效地实现了移动机器人的精确定位. 其次,由于姿态估计过程缺乏几何约束,提出了一种基于混合姿态估计模型的移动机器人三维地图创建方法. 该方法利用点云和纹理加权模型建立结合局部纹理约束的混合姿态估计方法,在保证定位精度的同时,降低了故障率.

最后,根据上述姿态估计算法构造关键帧选择机制,并使用基于视觉的闭环检测和优化算法来实现环境三维图的全局一致性优化. 在室内环境下的实验结果验证了该算法的有效性和可行性. (3)在基于主动视觉的移动视觉姿态估计算法的启发下,选择地面特征作为先验信息,提出了一种基于单眼相机的移动机器人视觉里程计估计方法. 首先,利用地面特征获取机器人运动过程中的数据关联,并建立基于单应性关系的移动机器人姿态估计模型. 在RANSAC算法的框架下对上述模型进行了求解,以实现非地面特征的粗略剔除和移动机器人的初始姿态估计. 在此基础上,利用特征三角形结构下的法线估计与特征点空间结构上的差异建立了非地面特征去除方法,有效地提高了移动机器人的定位精度. 同时,结合密集的光流估计算法,建立了密集的地面分割和移动机器人定位算法模型. 最后移动机器人建模,将所提出的可视里程计算方法应用于初始化和改进的PTAM算法,并结合对极搜索过程中特征的单应性约束,以实现围绕移动机器人的三维稀疏特征图的构建. 实验结果表明,所提出的视觉里程计算方法具有较高的定位精度,改进的PTAM算法可以有效地建立质量更高的三维特征图. (4)针对传统变分深度估计模型中缺乏几何约束的问题,引入了视角的光流平滑约束,并结合三维场景流算法建立了视觉反馈机制. 分别通过离散空间采样和特征三角网格划分的初始方法获得环境深度的初始值,并采用原始的对偶算法求解提出的算法模型,实现了密集的环境深度图估计. 最后,在建立的三维稀疏特征图上,实现了基于变异模型的移动机器人单眼视觉三维密集图的构建. 实验结果表明,该算法在一定程度上实现了移动机器人周围环境的3D建模,并验证了该算法的有效性和可行性.

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/tongxinshuyu/article-208106-1.html

下卡短信内容2015年中央全面深化改革领导小组确定的1

下卡短信内容2015年中央全面深化改革领导小组确定的1 ason/astn_astn lcd_fstn astn的区别

ason/astn_astn lcd_fstn astn的区别 中国电信话费支付购物_中国电信话费支付

中国电信话费支付购物_中国电信话费支付 2019年利润最高的农村农业,其中育种项目具有市场优势

2019年利润最高的农村农业,其中育种项目具有市场优势

美国说什么不对也对