苹果6电池怎么拆机图解点击有惊喜近一年各种深度学习平台和硬件(4)

电脑杂谈 发布时间:2018-01-08 21:08:00 来源:网络整理接下去是生成背景材质,包括产生minimap等。这个也很快,没什么计算量,把传过来的原始图像放到内存,告诉GPU就行。

稍微麻烦一些的是计算虚拟物体的光照。背景贴图的光照不需要计算,使用原图中的就可以。而虚拟物体需要从背景贴图抽取亮度和物体方向,还要计算光源方向。我还没有见过好的算法,不过有个取巧,就是生成一个光源,给一定角度从上往下照,如果对AR要求不高也凑合了。

其他的渲染部分,和VR有些类,什么ATW啊,Front Buffer啊,都可以用上,但是不用也没事,毕竟不是4K 120FPS的要求。总之,AR如果做的不那么复杂,对CPU和GPU的性能要求并不高,搞个图像识别模块,再多1-2个核做别的足矣。

如果在GPU上,那么还是得用传统的ACE口,一方面提高带宽,一方面与GPU的核交换数据在内部进行,当然,与CPU的交互必然会慢一些。

在使用安卓的终端设备上,深度学习可以用CPU/DSP/GPU,也可以是,但不管用哪个,一定要跟紧谷歌爸爸。谷歌以后会使用 Vulkan Compute来替代OpenCL,使用Vulkan 来替代OpenGL ES,做安卓GPU开发的同学可以早点开始熟悉了。

高通推过用手机做训练,然后手机间组网,形成强大的计算力。从我的角度看,这个想法问题多多,先不说实际应用,谁会没事开放手机给别人训练用?耗电根本就吃不消。并且,要是我知道手机偷偷上传我的图像和语音模板到别人那里,绝对不会买。

家庭市场(智能音箱):语义识别放在云端还是终端,将成争夺的焦点

第二个市场是家庭,包括机顶盒/家庭网关(4亿颗以下),数字电视(3亿颗以下),电视盒子(1亿以下)三大块。整个市场出货量在7亿片,电器里面的MCU并没有计算在内。这个市场公司比较散,MStar/ 海思/博通/ Marvell / Amlogic都在里面,小公司更是无数。如果没有特殊要求,拿平板的芯片配个wifi就可以用。当然,中高端的对画质还是有要求,MTK现在的利润从手机移到了电视芯片,屏幕显示这块有独到的技术。很多机顶盒的网络连接也不是以太网,而是同轴电缆等,这种场合也得专门的芯片。

最近,这个市场里又多了一个智能音箱,各大互联网公司又拿出当年追求手机入口的热情来布局,好不热闹。主要玩家如下:

其中,亚马逊和谷歌占大头,芯片均采用ARM Cortex-A小核做控制器,DSP做图像和语音处理的方式。其中,DSP的运算能力在10 Gops的INT8 MAC左右,并不高,价却不便宜,大于20美金。在芯片内部,DSP的主要作用还是回声消除,去噪,语音识别等。苹果6电池怎么拆机图解自然语言理解和神经网络计算并不是在设备端,而是在云端。在国内,百度和科大讯飞提供SDK甚至模块,不过还是需要连到云端才能启用完整功能。在芯片方面,国内有些公司已经发布了一些带深度学习的芯片,并集成语音处理模块和内存颗粒。未来这类芯片会更多,而软件平台,或者说语义处理到底放在云端还是终端,会成为争夺的焦点。

对于语音设别,如果是需要做自然语言理解,性能可能要到100Gops。对于无风扇设计引入的3瓦功耗限制,CPU/DSP和都可以选。不过工艺就得用28纳米了或者更早的了,毕竟没那么多量,撑不起16纳米。最便宜的方案,可以使用RISC-VDLA,没有生态系统绑定的情况下最省成本。

家庭电子设备里还有一个成员,游戏机。Xbox和PS每年出货量均在千万级别。VR/AR和人体识别早已经用在其中。

监控市场:能不能扔掉DSP?

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/shouji/article-59156-4.html

-

-

梅葆玖

梅葆玖以习主席为首的党中央采取一系列的改革措施和发展新思维挑战了美国的地位

-

肝付兼太

肝付兼太太夸张了

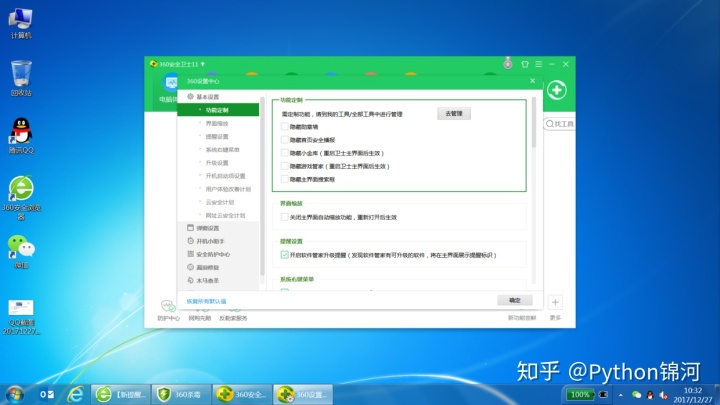

解决方案:您的计算机有360安全卫士吗?他是如何下载的!

解决方案:您的计算机有360安全卫士吗?他是如何下载的! 威龙新品(6888)-1/35德国虎式坦克中期型-奥托卡尔尤斯-马利诺夫卡之战

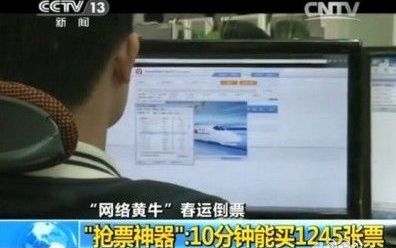

威龙新品(6888)-1/35德国虎式坦克中期型-奥托卡尔尤斯-马利诺夫卡之战 黄牛抢票可信吗?淘宝上的黄牛都变身在淘宝中

黄牛抢票可信吗?淘宝上的黄牛都变身在淘宝中 让腾讯道歉的火种代表着传统防病毒软件消失的五年!

让腾讯道歉的火种代表着传统防病毒软件消失的五年!

现在人们买白菜都挑有虫子的