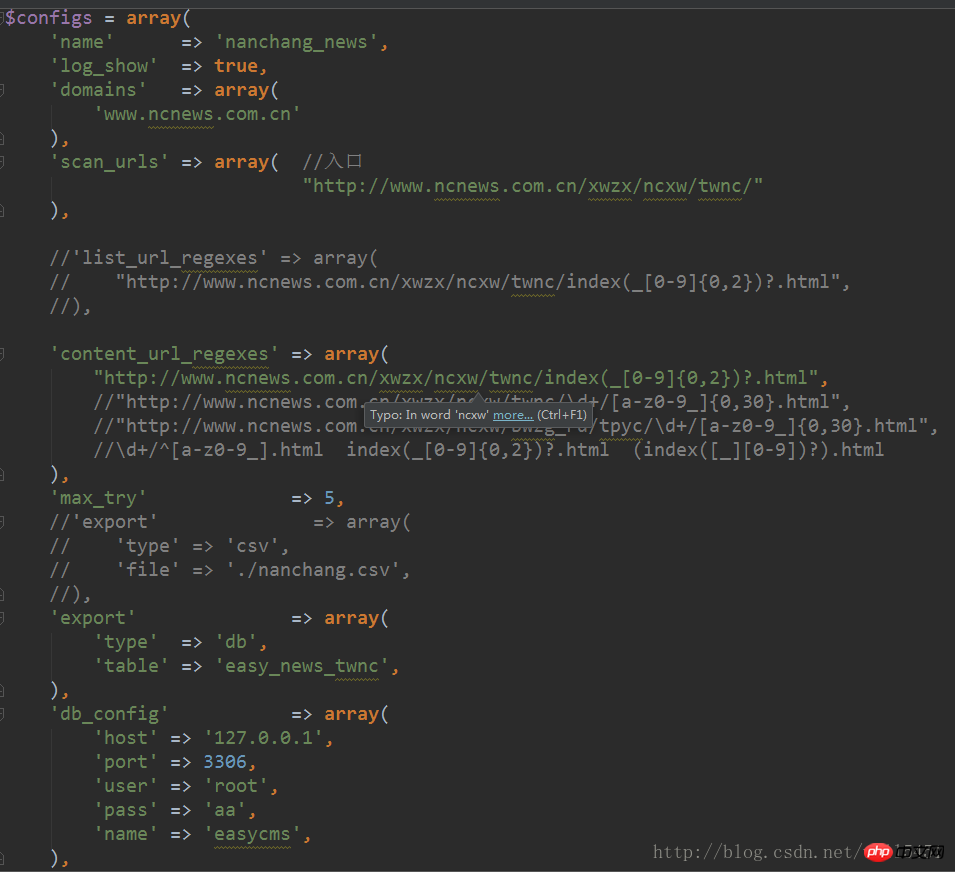

php爬虫代码文档介绍内容

电脑杂谈 发布时间:2020-02-27 09:01:31 来源:网络整理

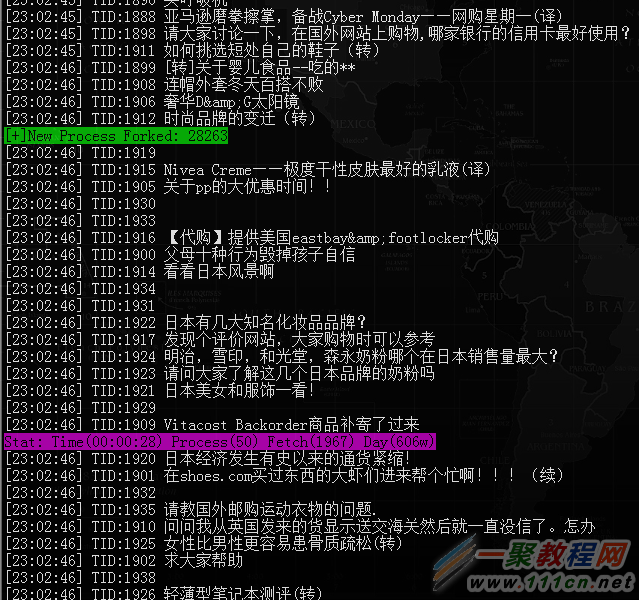

问题探讨:通过流量统计报告查看到百分之八十的流量都是来自蜘蛛爬虫。解决方案: 编写robots.txt文件上传到网页根目录中。使用类似于“Disallow:/禁止允许”的规则对蜘蛛爬虫进行禁止。减少蜘蛛抓取对网页产生的...

来自:阿里云>帮助文档

问题场景:客户使用虚拟主机,网站被搜索引擎爬虫访问耗费大量流量和带宽,如何处理。解决办法:可以借助在站点根目录下建立...GrabberYahoo Web PagesGooglebotLooksmartWebPages Slurp2.Robots.tx t样例代码: ...

来自:阿里云>帮助文档

Robots协议(也称为爬虫协议、机器人协议等)的简称是“网络爬虫排除标准”(Robots Exclusion Protocol),网站通过Robots协议告诉搜索引擎哪些页面可以抓取,哪些页面不能抓取。有时候有些页面访问消耗性能相当高...

来自:阿里云>帮助文档

本报告已统计网路爬虫造成的流量,不能作为网站整体流量的查询依据。操作方法: 登录主机管理控制台,单击 流量状态>访问统计报告>立即申请。流量统计报告只有在网站正常可访问状况下才能有流量数据,报告在申请24...

来自:阿里云>帮助文档

robots是网页和爬虫间的协议php 爬虫代码,用简单直接的txt格式文本形式告诉对应的爬虫被允许的权限。当一个搜索蜘蛛访问一个站点时,它会首先检测该站点根目录下是否存在robots.txt,如果存在php 爬虫代码,搜索机器人就会根据该文件中的...

来自:阿里云>帮助文档

网页中的敏感信息被恶意爬虫爬取。针对网站中常用的敏感信息泄露场景,防敏感信息泄露提供下述用途: 针对网页页面中出现的个人隐私敏感...例如,您可以借助修改以下防护规则,过滤admin.php页面中的号敏感信息。...

来自:阿里云>帮助文档

也有可能是其它网络爬虫、扫描器产生的联接消耗。建立连接数和放行连接数有哪些差异?建立连接数是说明3次握手成功的TCP连接这部分联结会包括设立连接后已发送有效载荷数据的TCP连接,而放行连接数仅包括设立TCP连接...

来自:阿里云>帮助文档

备份 分析型 MySQL版 分析型 PostgreSQL版 新BGP高防IP 爬虫风险管控 站点检测 DataV数据可视化 智能接入端口 备份DBS 云RDS PostgreSQL版 区块链服务 数据存贮服务DTS SCU存储容量...

来自:阿里云>帮助文档

由于互联网中存在诸多爬虫脚本,当WAF检测至对应请求(可能是爬虫脚本对WAF所生成的CNAME地址的请求),就会形成费用。因此,如果您想要推动WAF不造成任何成本,请删除WAF网站配置页面中的所有域名配置记录。WAF的按...

来自:阿里云>帮助文档

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/ruanjian/article-142245-1.html

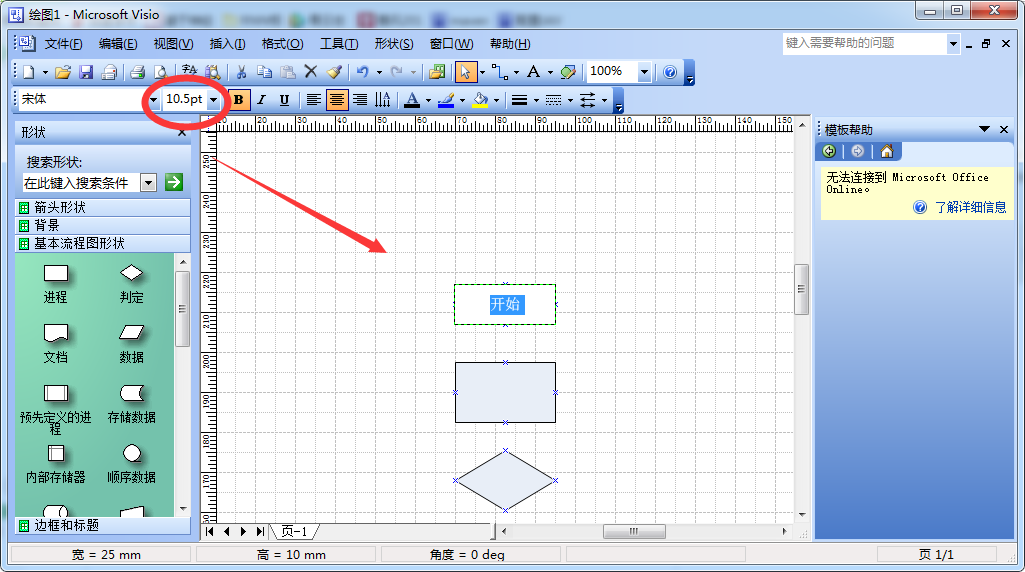

vsd文件_如何打开vsd文件_手机vsd文件

vsd文件_如何打开vsd文件_手机vsd文件 破解名人成功图片APP的密码以了解更多信息

破解名人成功图片APP的密码以了解更多信息 仿卡中卡官网 卡盟官网源码 卡盟宣传网站 卡盟

仿卡中卡官网 卡盟官网源码 卡盟宣传网站 卡盟 GRE词汇记忆共享方法: 新单词形成方法

GRE词汇记忆共享方法: 新单词形成方法

易烊千玺