字符串 从0到1:Python爬虫知识点梳理(2)

电脑杂谈 发布时间:2018-02-17 03:59:29 来源:网络整理

■数据清洗

数据清洗完最终要进行持久化存储,你可以用文件存储,比如CSV文件,也可以用存储,简单的用 sqlite,点用 MySQL,或者是分布式的文档 MongoDB,这些对Python都非常友好,有现成的库支持,你要做的就是熟悉这些 API 怎么使用。

进阶之路

从数据的抓取到清洗再到存储的基本流程都走完了,也算是基本入门了,接下来就是考验内功的时候了,很多网站都设有反爬虫策略,他们想方设法阻止你用非正常手段获取数据,比如会有各种奇奇怪怪的验证码限制你的请求操作、对请求速度做限制,对IP做限制、甚至对数据进行加密操作,总之,就是为了提高获取数据的成本。这时你需要掌握的知识就要更多了,你需要深入理解 HTTP 协议,你需要理解常见的加解密算法,你要理解 HTTP 中的 cookie,HTTP 代理,HTTP中的各种HEADER。爬虫与反爬虫就是相爱相杀的一对,道高一次魔高一丈。字符串

如何应对反爬虫没有既定的统一的解决方案,靠的是你的经验以及你所掌握的知识体系。这不是仅凭21天入门教程就能达到的高度。

作者:刘志军,6年+Python使用经验, 高级开发工程师,目前在互联网医疗行业从事Web系统构架工作

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-81414-2.html

相关阅读

发表评论 请自觉遵守互联网相关的政策法规,严禁发布、暴力、反动的言论

-

-

齐襄公吕诸儿

齐襄公吕诸儿壮哉我大函数新专辑大发

-

高敏

高敏而不是人为故意或无意放进去的

每日福利

日本超级计算机“ Fuyue”在6月20日荣登TOP500超级计算机榜首

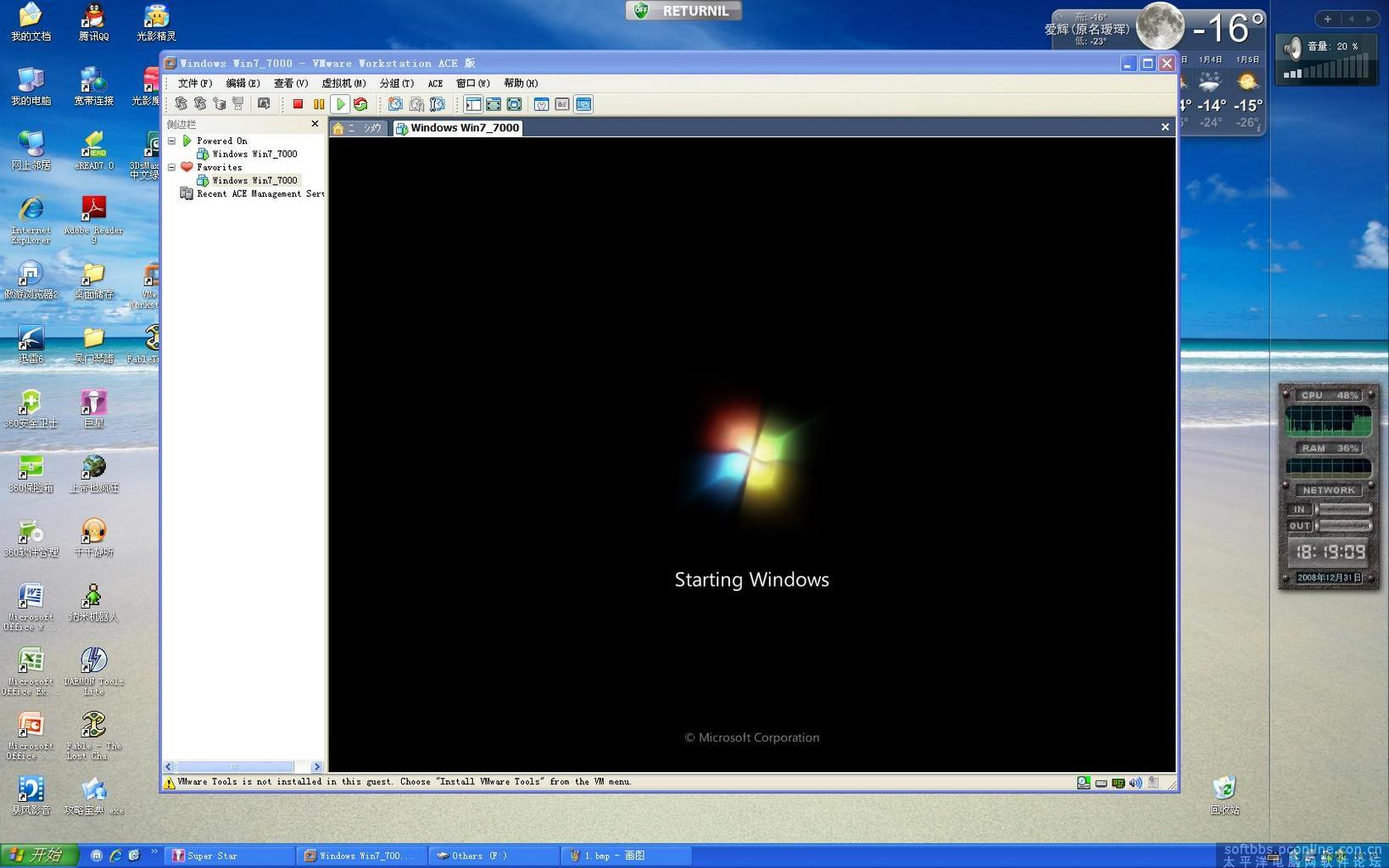

日本超级计算机“ Fuyue”在6月20日荣登TOP500超级计算机榜首 虚拟吉他手 win7_虚拟吉他手 是32位_虚拟吉他手使用

虚拟吉他手 win7_虚拟吉他手 是32位_虚拟吉他手使用 番茄花园windows7纯净版32位系统下载V1807

番茄花园windows7纯净版32位系统下载V1807 建设生态文明,促进新时期高质量林业发展

建设生态文明,促进新时期高质量林业发展

不存在蛆虫生存条件