模式识别分类 人工智能监控从可搜索视频开始(4)

电脑杂谈 发布时间:2018-02-10 14:18:00 来源:网络整理ACLU高级政策分析师Jay Stanley表示,即使我们能够解决这些自动化系统中的偏见,也不能使它们变得良性。他说,将闭路电视视频监控从被动的观察者转变为主动的观察者可能会对公民社会产生巨大的不利影响。

"我们希望人们不仅仅拥有自由,还要感受到自由。"

Stanley表示:"我们希望人们不仅仅拥有自由,还要感受到自由。这意味着他们不必担心未知的、看不见的观众会如何解释或曲解他们的每一个动作和话语。" Stanley表示:"要担心的是人们会不断地自我监控,担心他们所做的一切都会被曲解,并给他们的生活带来负面的后果。"

Stanley还表示,不准确的人工智能监控发出的错误警报也可能导致执法部门和公众之间更加危险的对抗。比如说,想想看Daniel Shaver的击事件吧,在看到Shaver拿着后,一名警察被叫到德克萨斯州的一个旅馆房间里。警长Charles Langley在Shaver按照他的要求趴在地面上时,开射杀了他。而Shaver被发现持有的是一支粒丸,这是他用来从事他的害虫控制工作的。

如果一个人可以犯这样的错误,电脑还有什么机会?而且,即使是监控系统变得部分自动化,这样的错误会变得更加常见还是更少?Stanley表示:"如果技术出现在那里,就会有一些警察不得不照看那里。"

当人工智能监控变得普及的时候,谁来管理这些算法呢?

Whittaker表示,我们在这个领域看到的只是人工智能大趋势的一部分,在这个趋势中,我们使用这些相对粗糙的工具,尝试着根据人们的形象对他们进行分类。她列举了去年发表的一项有争议的研究作为一个类似的例子,该研究声称能够通过面部识别来确定性取向。人工智能给出的结果的准确性值得怀疑,但批评人士指出,它是否有效并不重要;重要的是人们是否相信它有用,并且是否会仍然使用数据做判断。

Whittaker表示:"令我感到不安的是,许多这样的系统正在被注入我们的核心基础设施之中,而且没有让我们可以提出关于有效性问题的民主程序,也没有通知大家将要部署这些系统。"Whittaker表示:"这不过是正在出现的又一个新的例子:算法系统根据模式识别提供分类并确定个体类型,可是这些识别模式是从数据中提取的,而这些数据里包含了文化和历史的偏见。"

当我们向IC Realtime公司询问人工智能监控可能如何被滥用的问题时,他们给出了一个在科技行业常见的答案:这些技术是价值中立的,只是如何使用它们以及由谁来使用它们才决定了它们是好是坏。Sailor表示:"任何新技术都面临着有可能落入不法之徒的手中的危险。"Sailor表示:"任何技术都是如此……而我认为在这个问题上,利远大于弊。"

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-70151-4.html

-

-

青城丈人

青城丈人

的会计核算分录 地方水利建设基金计入什么科目?

的会计核算分录 地方水利建设基金计入什么科目? 易信注册时长_易信客服_易信下载安装

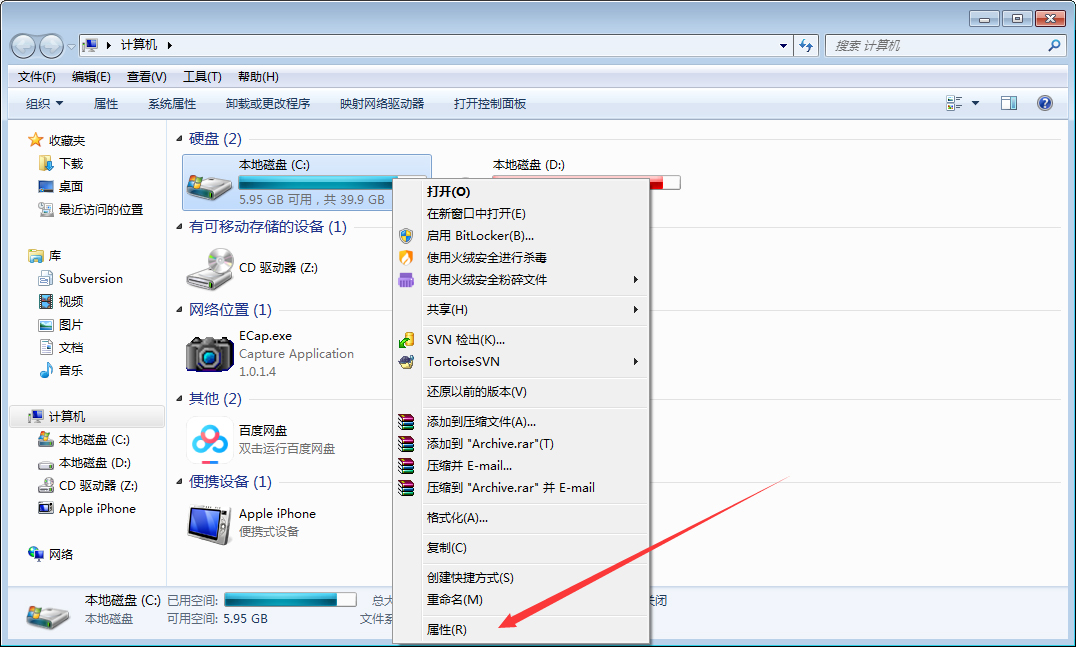

易信注册时长_易信客服_易信下载安装 如何扩展Win10计算机的C驱动器空间

如何扩展Win10计算机的C驱动器空间 昆山智慧云教育信息中心

昆山智慧云教育信息中心

作为正规小学毕业的人告诉泻教授