支持向量机通过寻找_r语言 支持向量机分类_支持向量机优缺点(3)

电脑杂谈 发布时间:2017-02-02 17:03:13 来源:网络整理在介绍R中函数的用法时,我们先简要介绍一下SVM的类型,以便我们更好地理解各个参数的设置。

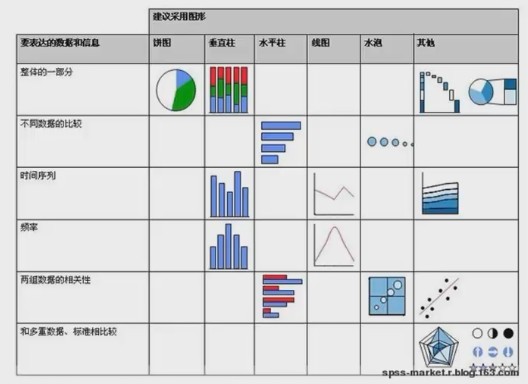

对于线性不可分时,加入松弛项,折衷考虑最小错分样本和最大分类间隔。增加了算法的容错性,允许训练集不完全分类,以防出现过拟合。加入的办法有以下3类,写成最优化问题形式总结如上图:

上图中e为所有元素都为1的列向量,Qij=yiyjK(xi; xj), K(xi; xj) =phi(xi) phi (xj), phi(.)为核函数,K(. ;.)表示对应元素核函数的内积。

现在我们来看看svm()函数的用法。

## S3 method for class 'formula'

svm(formula, data = NULL, ..., subset,na.action =na.omit, scale = TRUE)

## Default S3 method:

svm(x, y = NULL, scale = TRUE, type = NULL,kernel =

"radial", degree = 3, gamma = if(is.vector(x)) 1 else 1 / ncol(x),

coef0 = 0, cost = 1, nu = 0.5,

class.weights = NULL, cachesize = 40,tolerance = 0.001, epsilon = 0.1,shrinking = TRUE, cross = 0, probability =FALSE, fitted = TRUE, seed = 1L,..., subset, na.action = na.omit)

主要参数说明:

Formula:分类模型形式,在第二个表达式中使用的的x,y可以理解为y~x。

Data:数据集

Subset:可以指定数据集的一部分作为训练集

Na.action:缺失处理,默认为删除数据条目

Scale:将数据标准化,中心化,使其均为0,方差为1.默认自动执行。

Type:SVM的形式,使用可参见上面的SVMformulation,type的选项有:C-classification,nu-classification,one-classification (for novelty detection),eps-regression,nu-regression。后面两者为利用SVM做回归时用到的,这里暂不介绍。默认为C分类器,使用nu分类器会使决策边界更光滑一些,单一分类适用于所有的训练数据提取自同一个类里,然后SVM建立了一个分界线以分割该类在特征空间中所占区域和其它类在特征空间中所占区域。

Kernel:在非线性可分时,我们引入核函数来做非线性可分,R提供的核介绍如下:

线性核:u'*v

多项式核:(gamma*u'*v coef0)^degree

高斯核:exp(-gamma*|u-v|^2)

Sigmoid核:tanh(gamma*u'*v coef0)

默认为高斯核(RBF),libSVM的作者对于核的选择有如下建议:Ingeneral we suggest you to try the RBF kernel first. A recent result by Keerthiand Lin shows that if RBF is used with model selection, then there is no need to consider the linear kernel. The kernel matrix using sigmoid may not be positive definite and in general it's accuracy is not better than RBF. (see thepaper by Lin and Lin. Polynomial kernels are ok but if a high degree is used,numerical difficulties tend to happen (thinking about dth power of (<1) goes to 0 and (>1) goes to infinity).

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-30138-3.html

-

-

钱瑞娟

钱瑞娟使得多余的男性成为女性的消费品

在Win8中添加共享打印机的3种方法的详细说明

在Win8中添加共享打印机的3种方法的详细说明 文件操作 之 踩坑feof()函数和ftell()函数

文件操作 之 踩坑feof()函数和ftell()函数 计算机打开时“致命错误c0000034正在应用更新”的解决方案

计算机打开时“致命错误c0000034正在应用更新”的解决方案 第二次世界大战期间最大的超级战舰是什么(包括未建造和蓝色武器)

第二次世界大战期间最大的超级战舰是什么(包括未建造和蓝色武器)

导致北洋舰队大东沟海战失利