【算法】随机算法在数据智能和深度学习中有哪些应用?

电脑杂谈 发布时间:2020-05-31 08:25:06 来源:网络整理简介

机器学习的主要应用之一是对随机过程进行建模. 机器学习中的随机过程的一些示例如下:

泊松过程: 用于处理等待时间和排队. 随机游走和布朗运动过程: 用于交易算法. 马尔可夫决策过程: 常用于计算生物学和强化学习. 高斯过程: 用于回归和优化问题(例如,超参数调整和自动机器学习). 自回归和移动平均过程: 用于时间序列分析(例如ARIMA模型).

在本文中,我将向您简要介绍这些随机过程.

历史背景

随机过程是我们日常生活的一部分. 随机过程是如此特殊,因为它取决于模型的初始条件. 在上个世纪,庞加莱,洛伦兹和图灵等许多数学家都被这个话题所吸引.

今天,这种行为被称为确定性混沌,它的范围限制与真正的随机性大不相同.

由于爱德华·诺顿·洛伦兹(Edward Norton Lorenz)的贡献,混沌系统的研究在1963年取得了突破性的进展. 当时,洛伦兹(Lorenz)正在研究如何改善天气预报. 洛伦兹在分析中注意到,即使是很小的大气干扰也会引起气候变化.

洛伦兹用来描述这种状态的著名短语是:

“在巴西扇动翅膀的蝴蝶会在德克萨斯州产生龙卷风”

(在巴西,拍打翅膀的蝴蝶会在德克萨斯州造成龙卷风)

-爱德华·诺顿·洛伦兹(Edward Norton Lorenz)

(爱德华·诺顿·洛伦兹)

这就是为什么今天的混沌理论有时被称为“蝴蝶效应”的原因.

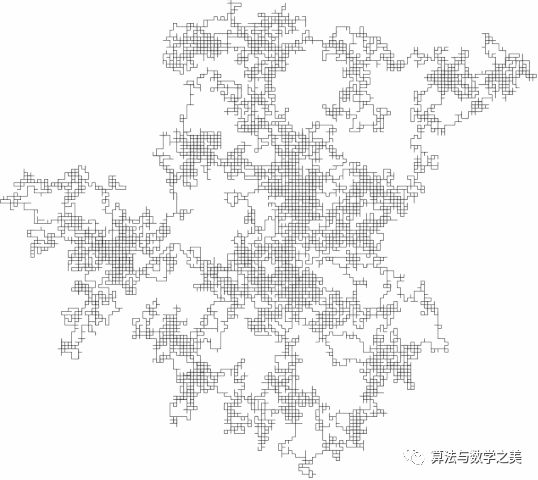

分形科学

一个简单的混沌系统的例子是分形(如图所示). 分形是一种以不同尺度连续重复的模式. 由于分形的缩放,分形与其他类型的几何图形不同.

Fractal是一种可以捕获混乱行为的递归驱动系统. 在现实生活中,分形的例子有: 树木,河流,云层,贝壳等.

图1: MC. 埃舍尔,越来越小[1]

艺术领域有许多自相似的图形. 毫无疑问,MC. 埃舍尔(Escher)是最著名的艺术家之一,他的作品受到数学启发. 实际上,在他的绘画中反复出现了各种不可能的物体,例如彭罗斯三角形和莫比乌斯带. 在“ Smaller and Smaller”中,他还反复使用了自相似性(图1). 除了蜥蜴的外圈,绘画中的内部图案也很相似. 每次重复,它都会包含一个半比例的复制图案.

确定性和随机过程

主要有两个随机过程: 确定性过程和随机过程.

在确定性过程中,如果我们知道一系列事件的初始条件(起点),则可以预测序列的下一步. 相反,在随机过程中,如果我们知道初始条件,则不能完全确定下一步是什么. 这是因为该过程可能以许多不同的方式发展.

在确定性过程中,所有后续步骤的概率为1. 另一方面,随机随机过程不是这种情况.

任何完全随机的东西对我们都没有用,除非我们能识别出这种模式. 在随机过程中,每个事件都是随机的,尽管可以识别连接这些事件的隐藏模式. 这样,我们的随机过程就不再神秘,可以对未来事件进行准确的预测.

为了用统计术语描述随机过程,我们可以给出以下定义:

例如,扔一个统一的是一个随机过程,但是由于数量大的规律算法的数据包括哪些,我们知道,如果进行大量的实验,我们将获得相同数量的正反面.

大数定律指出:

”随着样本量的增加,样本均值将接近总体均值或期望值. 因此,当样本量趋于无穷大时,样本均值会收敛于总体均值. 重要的是,在样本彼此独立. ”

-杰森·布朗利

随机过程的例子有股票市场和医学数据,例如血压和脑电图分析.

泊松过程

泊松过程用于对一系列离散事件进行建模. 在这些事件中,我们知道不同事件的平均时间,但是我们不知道这些事件何时发生.

如果随机过程可以满足以下条件,则可以将其视为泊松过程:

事件彼此独立(如果发生一个事件,则不会影响另一事件的可能性). 两个事件不能同时发生. 事件的平均发生率是恒定的.

让我们以停电为例. 电力供应商可能会宣称每10个月就会切断一次电源,但是我们无法准确告知下一次断电的时间. 例如,如果发生严重问题,则可能会连续2-3天断电(例如,公司需要对电源进行一些调整)算法的数据包括哪些,以便在接下来的两天内继续使用它.

因此,对于这种类型的随机过程,我们可以公平地确定事件之间的平均时间,但是它们以随机间隔发生.

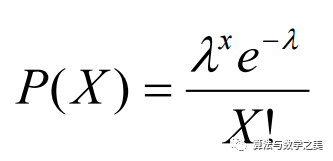

从泊松过程中,我们可以获得泊松分布,该泊松分布可用于得出不同事件之间的等待时间的概率,或一个时间段内可能发生的事件数.

可以使用以下公式(图2)对泊松分布进行建模,其中k表示一个时期内可能发生的预期事件数.

图2: 泊松分布公式[3]

可以使用泊松过程进行模拟的现象的一些示例是原子放射性衰变和股票市场分析.

随机行走和布朗运动过程

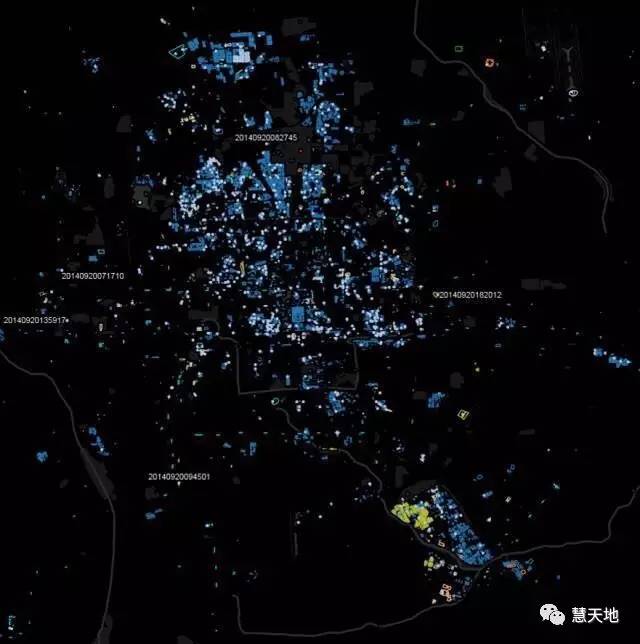

随机行走是可以在随机方向上移动的任意离散步骤(始终相同的长度)的序列(图3). 随机游走可以发生在任何维度空间(例如1D,2D,nD).

图3: 在高维空间中的随机游走[4]

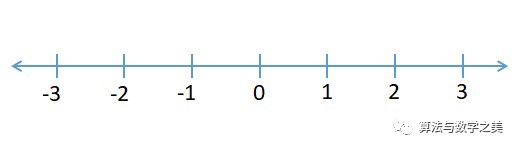

现在,我将向您介绍一维空间(数字轴)中的随机游动. 这里说明的概念也适用于更高的尺寸.

我们假设我们在公园里,并且看到一只狗在寻找食物. 它在数字轴上的当前位置为0,并且具有向左或向右移动以找到食物的相同概率(图4).

图4: 数字轴[5]

现在,如果我们想在N步后知道狗的位置,可以再次使用大数定律. 使用该定律,我们会发现当N趋于无穷大时,我们的狗可能会返回其起点. 无论如何,这种情况目前不是很有用.

因此,我们可以尝试使用均方根(RMS)作为距离度量(首先对所有值求平方,然后计算它们的平均值,最后对结果求平方). 这样,所有负数都变为正数,并且平均值不再等于零.

在此示例中,使用RMS,我们发现如果我们的狗走了100步,它将平均从原点移动10步(√100= 10).

如前所述,随机游走用于描述离散时间过程. 相比之下,布朗运动可以用来描述连续时间内的随机游动.

隐马尔可夫模型

隐藏的马尔可夫模型都是关于识别序列信号的. 他们在数据科学领域有很多应用,例如:

HMM是一种概率图形模型,用于从一组可观察状态预测隐藏(未知)状态序列.

这种类型的模型遵循马尔可夫过程假设:

“鉴于我们知道现在,未来独立于过去”

因此,在处理隐马尔可夫模型时,我们只需知道当前状态即可预测下一个状态(我们不需要有关前一个状态的任何信息).

要使用HMM进行预测,我们只需要计算隐藏状态的联合概率,然后选择产生最高概率(最可能出现)的序列即可.

为了计算联合概率,我们需要以下三种信息:

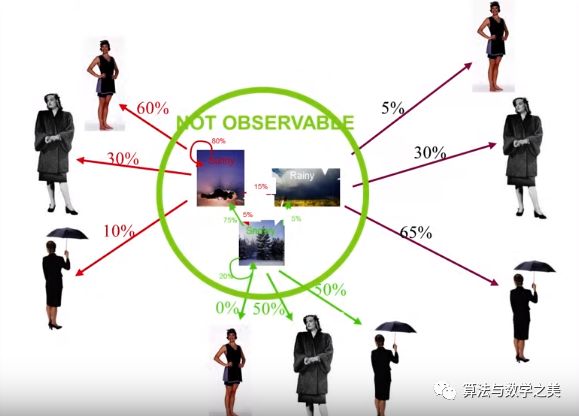

举一个简单的例子,假设我们试图根据一群人的穿着来预测明天的天气(图5).

在此示例中,不同类型的天气将成为我们的隐藏状态. 晴天,大风和雨天)和我们穿的衣服类型将成为我们可以观察到的状态(例如T恤,裤子和夹克). 初始状态是此序列的起点. 转换概率表示从一种天气切换到另一种天气的可能性. 最后,发射概率是某人根据前一天的天气穿着某件衣服的概率.

图5: 隐马尔可夫模型的例子[6]

使用隐马尔可夫模型的一个主要问题是,随着状态数量的增加,概率和可能状态的数量呈指数增长. 为了解决这个问题,可以使用维特比算法.

如果您对生物学中使用HMM和Viterbi算法的实用代码示例感兴趣,可以在我的Github代码库中找到它.

从机器学习的角度来看,观察值构成了我们的训练数据,隐藏状态的数量构成了我们要调整的超参数.

HMM在机器学习中最常见的应用之一是基于代理的场景,例如强化学习(图6).

图6: 强化学习中的HMM [7]

高斯过程

高斯过程是一类完全依赖自协方差函数的平稳零均值随机过程. 这样的模型可用于回归和分类任务.

高斯过程的最大优势之一是它们可以提供不确定性的估计,例如,为我们提供一种算法,可以确定某项是否属于某种类型的确定性估计.

为了处理嵌入一定程度不确定性的情况,通常使用概率分布.

离散概率分布的一个简单示例是掷骰子.

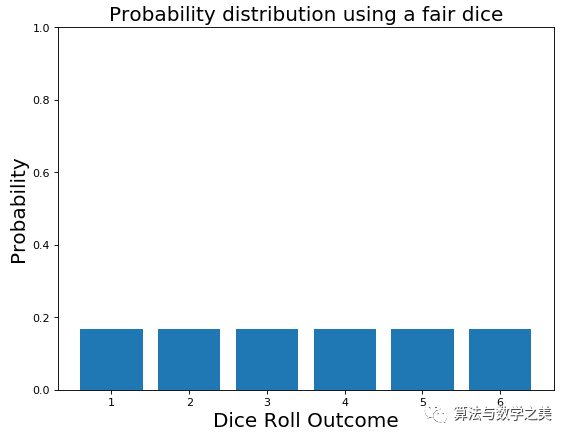

想象一下,您的一个朋友现在挑战您掷骰子,而您掷出50条发球. 对于公平骰子,我们预计六张面孔中每张面孔的概率相同(每张面孔1/6). 如图7所示.

图7: 掷骰子的公平概率分布

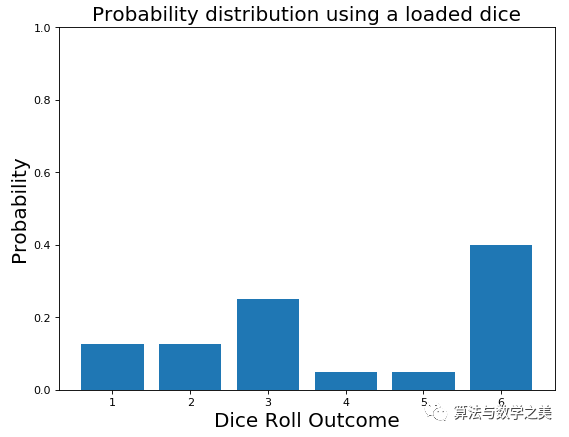

无论如何,您玩的越多,您越能看到骰子总是落在同一张脸上. 在这一点上,您开始认为骰子可能是不公平的,因此您改变了对概率分布的最初信念(图8).

图8: 不公平骰子的概率分布

此过程称为贝叶斯推理.

贝叶斯推理是基于新证据更新世界知识的过程.

我们从先前的信念开始,一旦使用全新的信息对其进行更新,我们便建立了后验信念. 这种推理也适用于离散分布和连续分布.

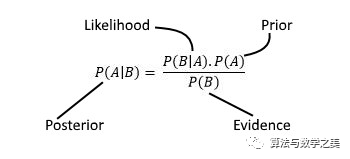

因此,高斯过程使我们能够描述概率分布. 一旦我们收集了新的训练数据,就可以使用贝叶斯规则(图9)来更新分布.

图9: 贝叶斯规则[8]

自回归移动平均过程

自回归移动平均(ARMA)过程是用于分析时间序列的非常重要的随机过程. ARMA模型的特征在于它们的自协方差函数仅取决于有限数量的未知参数(这对于高斯过程是不可能的).

缩写ARMA可以分为两个主要部分:

ARMA模型使用两个主要参数(p,q):

ARMA流程假设时间序列围绕恒定均值均匀波动. 如果我们尝试分析不遵循此模式的时间序列,则需要对该序列进行微分,直到分段序列是固定的.

————

编辑∑Gemini

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-228632-1.html

我可以感染乙肝多久?

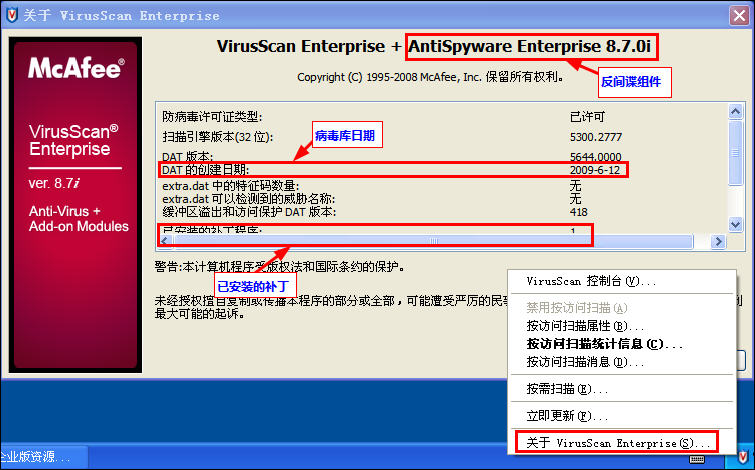

我可以感染乙肝多久? 四个个人防火墙软件评估的国际部分

四个个人防火墙软件评估的国际部分 超级计算机“神威·太湖之光”是世界上最快的

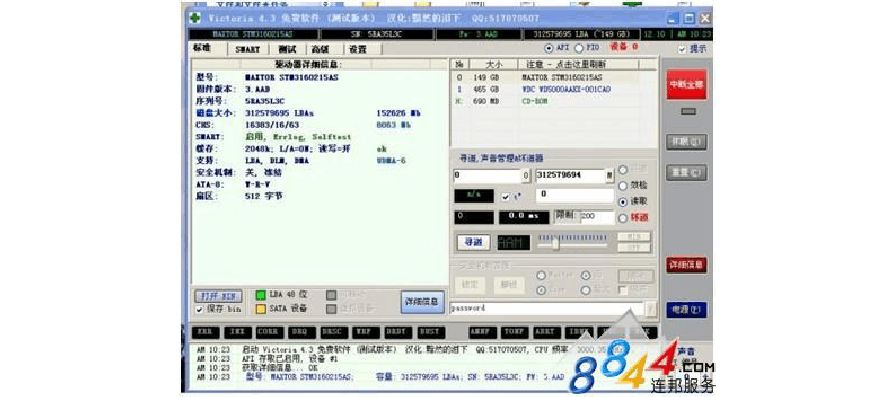

超级计算机“神威·太湖之光”是世界上最快的 硬盘修复_硬盘坏道屏蔽修复_硬盘坏道修复多少钱

硬盘修复_硬盘坏道屏蔽修复_硬盘坏道修复多少钱

没法形容的讨厌