特征离散化系列(1)方法概述

电脑杂谈 发布时间:2020-04-13 19:26:10 来源:网络整理

谢谢我的妻子,为该博客创建图片,您的支持是我坚持下去的动力

特征离散序列方法概述

数字离散化在数据挖掘和知识发现中起着重要作用. 许多研究表明归纳任务可以从离散化中受益: 离散值的规则通常更短,更容易理解,而离散化可以提高预测准确性. 文献中提到的许多归纳算法都需要离散特征. 所有这些功能都鼓励研究人员和从业人员在执行机器学习或数据挖掘任务之前离散化连续功能. 在文献中可以找到许多离散化方法. 本文旨在对离散化方法进行系统的研究,追踪其发展历史,以及这些方法对分类的影响,速度与准确性之间的权衡. 本文还给出了不同方法之间的对比实验并分析了结果. 本文的主要贡献是: 现有离散化方法的概述,现有离散化方法的层次结构描述(分层框架),为进一步的发展铺平道路,以及典型的离散化代表性离散化方法的简要讨论,大型实验和分析的数量,以及在不同应用环境中选择离散化方法的原理. 同时,它也发现了一些需要解决的问题,并对离散化进行了进一步的研究.

关键字: 离散化;连续特征数据挖掘;分类

本文的内容结构如下:

数据通常以混合形式出现: 名义,离散,连续. 离散或连续数据属于顺序数据类型,并且数据之间存在顺序. 但是,对于名义数据类型,数据之间没有顺序. 对于连续属性,值的数量是无限的,离散属性值通常受到限制. 学习分类树/规则时,这两种数据类型不同. 与连续属性值相比,离散属性值具有以下优点: ①通过离散化数据将得到简化和减少; ②离散功能易于理解,使用和解释; ③离散化使学习更加准确和快速; ④使用离散决策树(归纳规则)的结果更加紧凑,简短和准确. 结果更易于检查,比较,使用和重用; ⑤许多分类学习算法只能处理离散数据. 离散化是量化连续属性的过程. 离散化的成功可以大大扩展许多学习算法的范围.

本文回顾了现有的离散化方法,规范了离散化过程,在一个简短的框架中对其进行了总结,并为进一步的研究和开发提供了一些方便的参考. 本文中的其余工作安排如下. 第2节总结了离散化方法的当前状态;第三部分讨论了统一词汇表中的不同离散化方法,定义了离散化的一般过程,并考虑了离散化结果的不同评估方法,第四部分提出了一种新的离散化方法分层框架,简要描述了典型方法. 在描述每种典型方法时,我们基于基准数据集(基准数据集)虹膜给出了离散化结果. 数据集是一个小的数据集,通常用于离散化和分类工作,此处用于说明不同算法的工作过程. 第5节比较了不同方法的实验结果并分析了结果. 第六部分给出了选择离散化方法的标准和下一步.

在早期,诸如等宽和等频的技术被用于离散化. 随着对准确性的需求和有效分类算法的发展,离散化技术得到了迅速发展. 在过去的几年中,已经提出了许多离散化技术. 实验表明,离散化在减小数据大小甚至提高预测精度方有巨大潜力. 离散化方法是针对不同的主线开发的,以满足不同的需求: 有监督与无监督(有监督与无监督);动态与静态(动态与静态);全局与本地(全局与本地);自上而下和自下而上(拆分(自上而下)与合并(自下而上));直接与增量(直接与增量).

有监督与无监督(有监督与无监督): 离散化是监督还是无监督,这取决于离散化方法在离散化过程中使用分类信息. 监督离散化使用分类信息指导离散化过程;但是,无监督的离散化则不是. 没有分类信息的离散化方法类似于早期的等宽(equal-width),等频率(equal-frequency)技术: 根据用户预先指定的宽度(值的范围)或频率(实例数)每个区间)将连续范围划分为子范围.

当连续属性值的分布不均匀时,可能不会给出良好的结果. 因此,对于异常值(脆弱性)来说是弱的,因为它们明显影响值的范围. 为了克服该缺点,引入了监督离散化方法,并且使用分类信息来找到由切点定义的合适间隔. 已经设计出使用分类信息的不同方法以在连续属性上找到有意义的间隔. 如果没有可用的分类信息,则无监督离散化是唯一的选择. 文献中没有提到很多无监督的离散化方法,可能归因于离散化通常与分类任务有关.

动态与静态: 离散化方法的应用可以是动态的也可以是静态的. 所谓动态方法是指在建立分类器(例如.5)时,对连续值进行离散化,在进行分类任务之前完成静态离散化. [参考文献] [9]比较了动态和静态方法. 作者还报告了测试带有或不带有离散化功能的.5时的混合性能.

全球与本地: 另一个二分法是全球和本地. 局部离散化方法是在实例空间/实例子集的局部区域中进行离散化. 但是,全局离散化将整个实例空间用于离散化. 当实例空间的某个区域用于离散化时,局部方法通常与动态离散化方法有关.

自上而下和自下而上(拆分(自上而下)与合并(自下而上)): 离散化方法也可以根据自上而下和自下而上进行划分. 自上而下的方法从空的切点/分割点列表开始,然后在离散化过程中通过分割间隔将新的分割点连续添加到列表中. 从下至上从一个完整的列表开始,该列表使用所有连续特征值作为分割点,在离散化过程中,它连续给出通过此列表中的合并间隔删除的分割点.

直接vs.增量: 直接方法同时划分K个间隔的范围(例如,等宽,等频率,K均值),并且需要额外的输入来确定间隔的数量. 增量方法从简单的离散化开始,并伴随着改进或改进过程. 需要终止条件才能终止下一个离散化.

总而言之,有许多离散化方法,并将它们按不同维度进行分组. 有时,用户很难为手头的数据找到合适的方法. [文献] [9,4]提出了几种减轻这种困难的方法. 我们将继续对这些关键问题进行全面研究,包括: 离散化过程的定义(离散化过程的定义),性能度量(性能度量),广泛比较(广泛比较).

本文的贡献主要包括:

1)对典型离散化过程的简要说明;

2)新的层次结构框架,用于对文献中提到的现有离散化方法进行分类;

3)使用基准数据集系统地讨论不同离散化方法的结果;

4)比较在此框架下从基于公共数据集的分类学习算法的时间消耗和错误率两个维度中选择的9种代表性离散化方法;

5)详细检查比较结果;

6)给出有关在不同使用环境中选择哪种方法的指导,并提供进一步研究的指导;

首先,我们澄清几个术语以简要描述典型的离散化过程.

功能

特征,属性和变量是数据的一方面. 通常,在收集数据之前,应指定或选择要素. 特征可以是离散的,连续的和分类的. 在本文中,我们的兴趣主要在于离散连续特征的过程. 接下来,使用M代表数据集中的要素数量.

实例实例

实例(instance),元组(tuple)特征离散化,记录(recor),数据点(data point)都是数据记录的特征值. 实例的集合产生一个数据集. 通常,数据集的每一行代表一个实例,每一列代表一个要素. 令N表示数据中实例的数量.

切入点

术语“切点”是指连续值范围内的实际值,它将范围分为两个间隔. 一个间隔小于或等于该分割点,另一个间隔大于分割点. 例如,连续间隔[a,b]被分为[a,c]和[c,b],值c是分割点. 切点也称为分割点.

参数参数

术语arity是离散化环境中的间隔或划分的数量. 在离散化连续特征之前,将元数设置为k个连续特征划分的数量. 分割点的最大数量为k-1. 离散化过程减少了元图的数量,但是在元图的数量和分类或其他任务的执行之间折衷. 数字太大会使学习过程变长,但是数字太大会影响预测的准确性.

使用“典型”是指单变量离散化. 离散化可以是单变量或多变量. 单变量离散化一次仅离散化一个连续特征,而多元离散化同时考虑多个特征. 本文主要考虑单变量离散化. 在文章的最后,我们简要讨论了多元离散化作为单变量离散化的扩展.

典型的离散化过程通常包括以下4个步骤:

1)对离散化特征的连续值进行排序;

2)评估以评估划分的或相邻区间的合并点;

3)拆分或合并使用某些条件来划分或合并连续值的间隔;

4)停止以停止离散化.

排序排序

您可以按降序或升序对要素的连续值进行排序. 如果您不关心离散化过程中的排序,则排序的计算成本将非常昂贵. 对于所有功能,排序是在离散化开始之前完成的. 这将是全局处理特征离散化,适合离散化整个实例空间. 如果排序是在过程的每次迭代中完成的,那么这将是局部处理,仅离散整个实例空间的一个区域.

选择一个切入点

排序后,离散化过程的下一步是找到最佳分割点,划分连续值的范围,或找到要合并的最佳相邻间隔对. 典型的评估函数用于确定分类或合并与类别标签之间的关系. 文献中提到了许多评估函数,例如: 熵度量,统计度量. 评估功能及其应用将在下一节中讨论.

拆分/合并

我们知道,对于自顶向下的方法,间隔是划分的;但是,对于自下而上的方法,间隔是合并的. 对于除法,有必要评估除法点,选择最佳除法点,并将连续值范围分为两部分. 分别离散每个部分,直到满足停止标准为止. 对于合并,请评估相邻间隔并找到要合并的最佳间隔. 离散过程继续进行,并且间隔数量相应减少,直到满足停止条件为止.

停止条件

停止标准是终止离散过程. 通常,这是在精度和精确度之间进行折衷,因为这两者是正相关的. 我们可以将k设置为离散化结果的上限. 实际上,上限k的设置比N小得多. 假定没有特征连续值的副本,则停止条件可能非常简单,以固定数量的间隔开始,或者稍微复杂一些的评估函数. 下一节将介绍不同的停止标准.

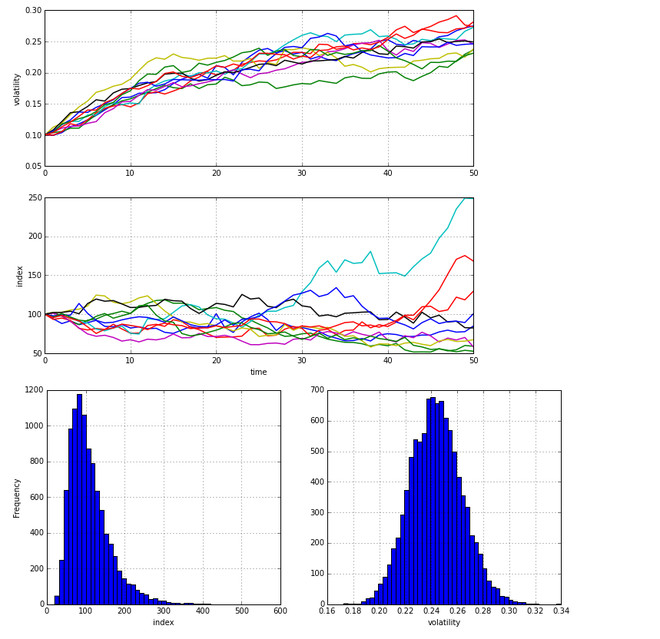

通过不同的离散化方法获得的离散化数据哪个更好?这似乎是一个简单的问题,但用简单的答案很难回答. 这是因为不同方法之间的比较是一个复杂的问题,它取决于特定应用程序中用户的需求. 这很复杂,因为可以从多个方面进行不同方法的评估. 我们列举了三个重要方面: (1)间隔的总数. 凭直觉,间隔点越少,离散化效果越好;但是强加的数据是有限的. 这导致了第二维. (2)离散化导致的不一致数量. 它不应大于离散化之前原始数据中的不一致数. 如果最终结果是根据数据训练分类器,则应考虑另一种观点. (3)预测精度-离散化提高了预测精度. 简而言之,我们至少需要考虑三个维度: 简单性,一致性和准确性. 理想情况下,最好的离散化结果应该在所有三个方面都具有最高的分数. 但是实际上,这是不可能实现的,或者是不必要的. 本文的目的也是针对不同的离散化方法提供这三个方面的平衡视图.

使用分割点的总数定义简单性. 可以通过在交叉验证模式下运行分类器来获得准确性. 一致性(consistency)是最小的不一致计数值,可以通过以下三个步骤来计算(在以下描述中,模式是指没有类别标签的实例): (1)如果两个实例具有相同的属性值,但是类别标签不同,则两个实例不一致. 例如,如果两个实例分别为(0 1; 0)和(0 1; 1),则它们不一致. (2)模式的计数值是该模式在数据中出现的次数减去类别标签的最大数量;例如,假设有n个实例与此模式匹配,其中label1的数量为c1的数量,label2为c2的数量,label3的数量为c3的数量,其中c1 + c2 + c3 = n. 如果c3是三个中的最大值,则该模式的不一致计数值为(n-c3). (3)总不一致性计数是一个功能集中所有可能模式的不一致性计数之和.

文献中提到了许多离散化方法. 如上所述,可以根据不同的维度对这些方法进行分类. 即: 有监督与无监督;有监督与无监督;动态与静态;全球与本地;自上而下和自下而上(拆分(自上而下)与合并(自下而上));直接与增量. 这些方法可以根据这些维度的不同组合进行分组. 我们希望建立一个系统的,可扩展的框架,以涵盖当今的所有方法. 文献中提到的每种离散化方法都会离散化一个特征: 将间隔除以连续值;或合并相邻间隔. 根据是否使用分类信息,可以将划分和合并进一步分为有监督的和无监督的.

鉴于这些考虑,我们提出了一个层次框架(hierarchical framework),如下所示.

通过两种方法: 划分和合并,描述了不同的离散化度量(级别1). 然后,我们考虑该模式是有监督的还是无监督的(级别2). 此外,我们使用相同的离散化度量方法(级别3)(例如装箱和熵)将它们分组在一起. 如下图所示,有监督和无监督之间的划分确定了不同的测量方法. 因此,将不详细描述概念上有用的划分.

我们将在下表中基于划分和合并的分类方法来讨论现有的各种测量方法.

在以下两个小节中,将选择典型方法进行深入讨论. 它们的相关或派生的措施也将简要介绍. 对于每种离散测量方法,我们主要给出:

(1). 测量方法的定义;

(2). 在离散化方法中的应用;

(3). 使用了停止条件;

(4). Iris数据集的离散化结果: 每个属性的分割点;

为便于比较,在小节末尾,我们列出了所有离散化度量的结果: 不一致的数量,离散化分裂点.

我们从划分离散化方法的通用算法开始.

离散化过程中的分割算法包括四个步骤,分别是:

(1). 对功能值进行排序;

(2). 搜索合适的分割点;

(3). 根据划分点划分连续值的范围;

(4). 当满足停止条件时停止离散化,否则继续;

文献中提到了许多离散化方法: 合并,熵,相关性和准确性.

注意: 对于这些方法,我们将打开一个独立博客来解释讨论.

我们从使用合并或自底向上方法的离散化通用算法开始.

在离散化过程中,合并算法包括4个重要步骤,分别是:

(1). 对值进行排序;

(2). 找到最佳的两个相邻间隔;

(3). 将这对组合成一个间隔;

(4). 满足停止条件时终止.

注意: 对于这些方法,我们将打开一个独立博客来解释讨论.

我们回顾了在划分和合并分类的情况下典型的离散化方法. 大多数方法是基于除法的. 我们以虹膜数据集为例,展示了不同离散化方法的结果. 这两个指标之间的直观关系(不一致数量和切点数量)是: 除法点越多,不一致的计数越少. 仔细观察表明,两种计数都不太可能采用中间方法. 因此,我们的目标应该是使两者的数量(不一致和切点的数量)都变小. 我们确实发现,用于虹膜数据的某些方法比其他方法更好: Ent-MDLP是除法中最好的方法; chi2是合并方法中最好的. Chi2还表明,通过考虑一定程度的不一致,也有可能在两种措施之间达成折衷. 除了离散化之外,Chi2还删除了具有一定程度不一致的特征.

在第2节中,我们回顾了有监督与无监督(有监督与无监督);动态与静态;全球与本地;自上而下的离散拆分方法(自上而下)与合并(自下而上);直接与增量. 在多维视图下,我们还有另一种类型的分组. 如下表所示:

此博客主要总结了特征离散化方法. 下一个博客将解释具体的离散化方法及其测试方法.

博客预览: 最近,我将发布卷积神经网络之父Yann LeCun的基于能量的模型,以及基于该模型的协作人脸检测和姿态估计算法以及实验实现. 欢迎大家注意.

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-174490-1.html

-

-

张林婷

张林婷赔一件就行

给台湾30年时间