搜索引擎的基本工作原理_网盘引擎搜索_搜索图片的引擎

电脑杂谈 发布时间:2019-07-05 03:07:10 来源:网络整理

专家为您解读《百度移动搜索建站优化白皮书》,2017年11月,百度发布《百度移动搜索建站优化白皮书》(后续简称移动建站白皮书),移动建站白皮书,目的在于让广大站长充分了解百度搜索引擎规则,并根据规则合理安全建设网站、优化网站,从而更好的获取搜索流量,共建良性搜索生态,整理出此白皮书。【科技讯】12月8日消息,2017年11月,百度发布《百度移动搜索建站优化白皮书》,据官方说明,此移动搜索建站优化白皮书更有利于让广大站长们充分了解百度搜索引擎规则,并可根据规则合理安全建设网站、优化网站,从而更好的获取搜索流量,共建良性搜索生态。另外百度云方面还提供了相关的一些工具,其中在搜索引擎方有代表性的产品叫做“搜索推广解决方案”,在搜索推广解决方案中有一项名为“搜索referer api”的东西,在百度云网络环境内提供实时和批量获取api,站长通过提供其网站referer关键词的eqid可以获取对应的自然搜索流量的搜索关键词。

本章主要内容分为四个章节,分别为:抓取建库;检索排序;外部投票;结果展现。

第一节-抓取建库

Spider抓取系统的基本框架

互联网信息爆发式增长,如何有效的获取并利用这些信息是搜索引擎工作中的首要环节。数据抓取系统作为整个搜索系统中的上游,主要负责互联网信息的搜集、保存、更新环节,它像蜘蛛一样在网络间爬来爬去,因此通常会被叫做“spider”。例如我们常用的几家通用搜索引擎蜘蛛被称为:Baiduspdier、Googlebot、Sogou Web Spider等。

Spider抓取系统是搜索引擎数据来源的重要保证,如果把web理解为一个有向图,那么spider的工作过程可以认为是对这个有向图的遍历。从一些重要的 URL开始,通过页面上的超链接关系,不断的发现新URL并抓取,尽最大可能抓取到更多的有价值网页。对于类似百度这样的大型spider系统,因为每时 每刻都存在网页被修改、删除或出现新的超链接的可能,因此,还要对spider过去抓取过的页面保持更新,维护一个URL库和页面库。

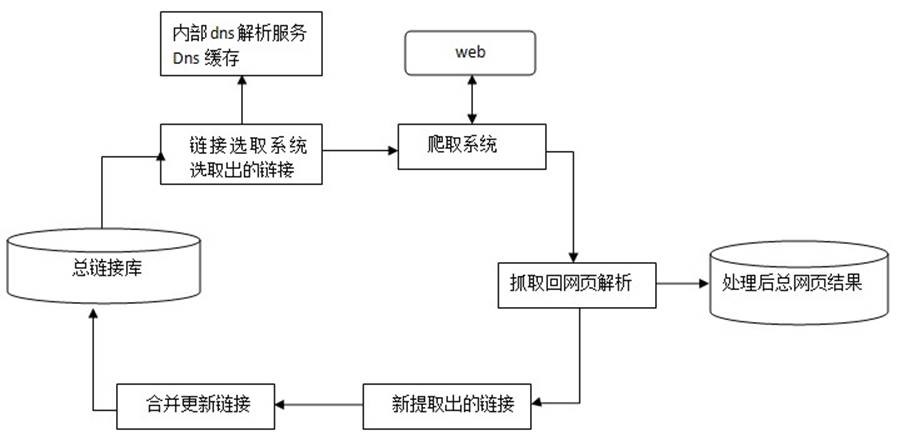

下图为spider抓取系统的基本框架图,其中包括链接存储系统、链接选取系统、dns解析服务系统、抓取调度系统、网页分析系统、链接提取系统、链接分析系统、网页存储系统。Baiduspider即是通过这种系统的通力合作完成对互联网页面的抓取工作。

Baiduspider 主要抓取策略类型

但这些搜索引擎抓取动态页面时,为了避免"搜索机器人陷阱"(spider traps,脚本错误,这种错误会让搜索机器人进行无限循环的抓取,无法退出)",都只抓取从静态页面链接过去的动态页面,而从动态页面链出去的动态页面都不再抓取,即不会对动态页面中的链接进行深入访问。这里只讲述一些比较少用(相对来说)的dos命令,常用命令如copy、dir等就不做介绍了(这些看似简单的命令实际复杂的很,我怕自己都说不清楚。简单来说站点地图指的是网站栏目和内容的一个集合页面,可以把网站的栏目和内容汇聚到一个页面,这样的这样的话,这个页面就包含了所有内容和栏目的链接,当蜘蛛抓取到地图的链接的时候就可以抓取到更多的网站内容和栏目的链接。

1、抓取友好性

有一些网页,内容优质,用户也可以正常访问,但是baiduspider却无法正常访问并抓取,造成搜索结果覆盖率缺失,对百度搜索引擎对站点都是一种损失,百度把这种情况叫“抓取异常”。另外一种友好性则是,希望爬虫对某网站的访问造成的网络负载较低.爬虫一般会根据网页的链接连续获取某网站的网页,如果爬虫访问网站频率过高,会给网站服务器造成很大的访问压力.有时候其至会影响网站的正常访问,造成类似dos攻击的效果,所以为了减少网站的网络负载,友好性的爬虫应该在抓取策略部署时考虑每个被抓取网站的负载.在尽可能不影响爬虫性能的情况下,减少对单一站点短期内的高频访问。网站访问控制及带宽限制网站访问控制及带宽限制代理服务器ccproxy的网站过滤功能,可以设置只允许访问指定的网站或禁止访问指定的网站。

通常情况下搜索引擎的基本工作原理,最基本的是基于ip的压力控制。这是因为如果基于域名,可能存在一个域名对多个ip(很多大网站)或多个域名对应同一个ip(小网站共享ip)的问题。实际中,往往根据ip及域名的多种条件进行压力调配控制。同时,站长平台也推出了压力反馈工具,站长可以人工调配对自己网站的抓取压力,这时百度spider将优先按照站长的要求进行抓取压力控制。

对同一个站点的抓取速度控制一般分为两类:其一,一段时间内的抓取频率;其二,一段时间内的抓取流量。同一站点不同的时间抓取速度也会不同,例如夜深人静月黑风高时候抓取的可能就会快一些,也视具体站点类型而定,主要思想是错开正常用户访问高峰,不断的调整。对于不同站点,也需要不同的抓取速度。

2、常用抓取返回码示意

简单介绍几种百度支持的返回码:

1)最常见的404代表“NOT FOUND”,认为网页已经失效,通常将在库中删除,同时短期内如果spider再次发现这条url也不会抓取;

1)404 返回码的含义是 “not found”,百度会认为网页已经失效,那么通常会从搜索结果中删除,并且短期内 spider 再次发现这条 url 也不会抓取。【404】404返回码的含义是“not found”,百度会认为网页已经失效,那么通常会从搜索结果中删除,并且短期内spider再次发现这条url也不会抓取。404 返回码的含义是 “not found”,百度会认为网页已经失效,那么通常会从搜索结果中删除,并且短期内 spider 再次发现这条 url 也不会抓取。

3)403代表“Forbidden”,认为网页目前禁止访问。如果是新url,spider暂时不抓取,短期内同样会反复访问几次;如果是已收录url,不会直接删除,短期内同样反复访问几次。如果网页正常访问,则正常抓取;如果仍然禁止访问,那么这条url也会被认为是失效链接,从库中删除。

当遇到站点迁移、域名更换和站点改版的情况时,推荐使用301返回码,尽量减少改版带来的流量损失。因网站结构设置不合理,导致网站无法被快速识别抓取的事例在百度日常反馈中经常见到,且网站换域名也会对网站造成一定损失,故希望各位站长从建站之初重视网站结构设置,避免不必要的损失。部分站长会选择通过换域名来提高站点运营效果,但站长们应该明确一点:网站只要发生大大的变化(如换域名、子目录改版为二级域名等),流量就会受到损失。

3、多种url重定向的识别

互联网中一部分网页因为各种各样的原因存在url重定向状态,为了对这部分资源正常抓取,就要求spider对url重定向进行识别判断,同时防止作弊行为。重定向可分为三类:http 30x重定向、meta refresh重定向和js重定向。另外,百度也支持Canonical标签,在效果上可以认为也是一种间接的重定向。

4、抓取优先级调配

由于互联网资源规模的巨大以及迅速的变化,对于搜索引擎来说全部抓取到并合理的更新保持一致性几乎是不可能的事情,因此这就要求抓取系统设计一套合理的抓取优先级调配策略。主要包括:深度优先遍历策略、宽度优先遍历策略、pr优先策略、反链策略、社会化分享指导策略等等。每个策略各有优劣,在实际情况中往往是多种策略结合使用以达到最优的抓取效果。

5、重复url的过滤

spider在抓取过程中需要判断一个页面是否已经抓取过了,如果还没有抓取再进行抓取网页的行为并放在已抓取网址集合中。判断是否已经抓取其中涉及到最核心的是快速查找并对比,同时涉及到url归一化识别,例如一个url中包含大量无效参数而实际是同一个页面,这将视为同一个url来对待。

6、暗网数据的获取

互联网中存在着大量的搜索引擎暂时无法抓取到的数据,被称为暗网数据。一方面,很多网站的大量数据是存在于网络中,spider难以采用抓取网页的方式获得完整内容;另一方面,由于网络环境、网站本身不符合规范、孤岛等等问题,也会造成搜索引擎无法抓取。目前来说,对于暗网数据的获取主要思路仍然是通过开放平台采用数据提交的方式来解决,例如“百度站长平台”“百度开放平台”等等。

7、抓取反作弊

spider在抓取过程中往往会遇到所谓抓取黑洞或者面临大量低质量页面的困扰,这就要求抓取系统中同样需要设计一套完善的抓取反作弊系统。例如分析url特征、分析页面大小及内容、分析站点规模对应抓取规模等等。

Baiduspider抓取过程中涉及的网络协议

刚才提到百度搜索引擎会设计复杂的抓取策略,其实搜索引擎与资源提供者之间存在相互依赖的关系,其中搜索引擎需要站长为其提供资源,否则搜索引擎就无法满足用户检索需求;而站长需要通过搜索引擎将自己的 内容推广出去获取更多的受众。spider抓取系统直接涉及互联网资源提供者的利益,为了使搜素引擎与站长能够达到双赢,在抓取过程中双方必须遵守一定的 规范,以便于双方的数据处理及对接。这种过程中遵守的规范也就是日常中我们所说的一些网络协议。

以下简单列举:

http协议:超文本传输协议,是互联网上应用最为广泛的一种网络协议,客户端和服务器端请求和应答的标准。客户端一般情况是指终端用户,服务器端即指网 站。终端用户通过浏览器、蜘蛛等向服务器指定端口发送http请求。发送http请求会返回对应的httpheader信息,可以看到包括是否成功、服务 器类型、网页最近更新时间等内容。

https协议:实际是加密版http,一种更加安全的数据传输协议。

点中 tcp/ip 协议,选择'属性',我们可以来检查 sqk server 服务默认端口的设置。2、安装服务公布协议右键点网上邻居,点属性,在任意一个“本地连接”上点右键,点属性,点安装,选择服务,点添加,选择服务公布协议,点确定。前面篇介绍onvif服务端的发现功能,继续在之前的代码基础上完成一个rtsp流的工作,也就是客户端通过onvif协议来预览设备端在这个之前必须确定几个简单的条件1 设备端能被发现2 设备端支持rtsp协议,并且能够通过vlc进行正常的预览通过onvif协议设备需要做的几个基本事情:1 __tds__getcapabilities获取设备能力2 __trt__getprofiles获取设备的配置信息3 获取前段设备的视频编码和视频源的一些基本需要的信息4 __trt__getstreamuri后去设备的uri,通过rtsp获取视频流接口函数有了,实现的时候当然也需要注意匹配,需要把设备的一些主要信息对应匹配到onvif协议中,下面一个函数一个函数的具体实现如下,在需要注意的地方我都加上了对应的注释,如果还有不清楚的地方可以留言,我会尽量尽我所知道的告诉大家1 __tds__getcapabilities,此函数是获取设备端的能力的函数,在这里需要预览,所以基本的media和device的一些基本信息是需要填写的[cpp] view plaincopycapabilities__device_choice:tds__getcapabilitiesresponse->capabilities->device=(structtt__devicecapabilities*)soap_malloc(soap,sizeof(structtt__devicecapabilities))。

robots协议:robots.txt是搜索引擎访问一个网站时要访问的第一个文件,用以来确定哪些是被允许抓取的哪些是被禁止抓取的。 robots.txt必须放在网站根目录下,且文件名要小写。详细的robots.txt写法可参考 。百度严格按照robots协议执行,另外,同样支持网页内容中添加的名为robots的meta标 签,index、follow、nofollow等指令。

Baiduspider抓取频次原则及调整方法

网站的内容质量是搜索引擎蜘蛛对网站抓取频次的一个重要因素,如果网站每天都有质量高、原创度高、能解决用户的需求的内容,抓取频次会相应的提高。baiduspider根据上述网站设置的协议对站点页面进行抓取,但是不可能做到对所有站点一视同仁,会综合考虑站点实际情况确定一个抓取配额,每天定量抓取站点内容,即我们常说的抓取频次。在网站建设中,只要紧密贴合用户需求和搜索引擎的抓取习惯来对网站进行部署,那就会大大提升网站的优化效果,建设一个有利于优化的站点才是持续发展的根本,只有重视好每一个优化环节,那么网站才会受到越来越多用户的青睐,以此来提升网站品牌影响力。

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-110562-1.html

-

-

黄梦辉

黄梦辉这个世界好不公平

-

伊井塚龙姬

伊井塚龙姬来战

windows xp sp3补丁包下载 简体中文版

windows xp sp3补丁包下载 简体中文版 秋天的无痕一键优化

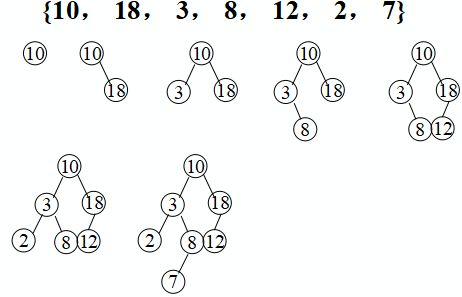

秋天的无痕一键优化 23个二叉搜索树的后遍历序列

23个二叉搜索树的后遍历序列 谈论僵尸网络武器: 快速通行技术

谈论僵尸网络武器: 快速通行技术

美国是提防中国对它先进舰的信息捕获