2018超级计算机研究报告(AMiner发布)(3)

电脑杂谈 发布时间:2019-06-15 18:14:38 来源:网络整理(2) 神威·太湖之光

神威·太湖之光是由中国国家并行计算机工程技术研究中心研制的超级计算机,2016 年6 月 20 日在 LINPACK 性能测试中以 93 Pflops 的测试结果超越同为中国组建的天河二号(LINPACK 成绩约为 34 Pflops),成为世界上最快的超级计算机,直到 2018 年 6 月 8 日被美国的超级计算机 Summit 超越。

目前神威·太湖之光部署在江苏省无锡市的国家超级计算无锡中心,由清华大学负责运营。它的组件均由中国自主设计生产,是中国大陆首个不使用英特尔等美国公司的核心产品而登上 TOP500 第一名宝座的超级计算机。

“神威•太湖之光”是世界第一台速度超过每秒10亿亿次的超级计算机,它的峰值运算速度达到了每秒12.54亿亿次,持续计算速度可达每秒9.3亿亿次,功耗比为每瓦60.51亿次。anandtech评测运行crysis 3时295x2整机功耗比780 ti sli整机功耗高130瓦,computerbase同样运行crysis 3时295x2整机功耗比780 ti sli整机功耗高102瓦,如果295x2有500瓦,考虑到其他配件的功耗也要受到电源转换效率影响造成放大效应,295x2和780 ti sli的实际差距估计50瓦还是有的,难道780 ti sli只有450瓦。数据显示,“神威·太湖之光”超级计算机峰值计算速度达每秒12.54亿亿次,持续计算速度每秒9.3亿亿次,性能功耗比为每瓦60.51亿次,3项关键指标均排名世界第一。

清华大学地球系统科学系与计算机系合作,利用“神威·太湖之光”首次实现了百万核规模、高分辨率的地球系统数值模拟。此前,中国大陆的地球模拟系统模式一般采用百公里网格规模的分辨率,但现在已可开展 25 公里网格分辨率的地球系统模拟工作,在海洋上可达到 10 公里分辨率。目前,三十多家用户单位在天气气候、航空航天、海洋科学、新药创制、先进制造、新材料等领域与国家超级计算机无锡中心开展了合作。2016 年,神威·太湖之光上的“千万亿次八百五十万核可扩展非静力大气动力全隐求解器”应用软件获得“戈登·贝尔”奖。2017 年,基于神威·太湖之光的“非线性大地震模拟”再次获得“戈登·贝尔” 奖7。此年度“戈登·贝尔”奖提名。

(3) Sierra

Sierra,代号 ATS-2,是 IBM 为美国能源部下属的劳伦斯利福摩尔国家实验室建造的超级计算机,由美国国家核安全局管理,Sierra 与前文提到的橡树岭国家实验室的 Summit 使用几乎相同的架构。Sierra 的运算节点采用 IBM 的 Witherspoon S922LC Open Power 主机, 每台主机中配备 IBM POWER9 CPU 配以 NVIDIA Tesla V100 运算加速卡,CPU 和加速卡之间使用 NVLink 连接,每颗 CPU 配以两块运算加速卡,节点之间的连接采用 EDR InfiniBand8。

超级计算机技术有三个层次:基础层、中间层和应用层。其中,基础层主要是超级计算机的基本原理与方法,应用层涉及超级计算机使用场景,而中间层则包含了数据存储、计算、管理等多重技术支持,正是有了中间层的链接,超级计算机原理才能落实到应用问题解决之中。

图 4 超级计算机技术分层

(1) 基本原理

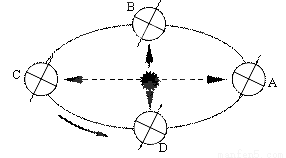

超级计算的基本原理是并行计算,其优点是可以节省时间、处理大型问题、提高准确度。在这种方法中,整个求解问题被分成 n 干份,然后每个部分各由一个处理机\并行计算,理论上,求解问题可以以 1/n 时间完成,但实际情况中,求解的问题通常不能很好地划分为各个独立部分,各个部分之间必须进行交互,包括计算中的数据传送和同步。因此,超级计算的性能优化之一是提高并行可扩展性。目前来看,硬件层面并行化的实现手段为:多重执行单元、连接结构、多核处理等。

(2)架构分类

按照并行计算方式是单指令多数据流(SIMD)还是多指令多数据流(MIMD),存储器是共享还是分布,可以将超级计算机系统的架构作如下划分:

图 5 超级计算机系统的架构分类

早期的超级计算机系统以 SIMD 方式工作。由于系统中的各个处理器按阵列方式排列, 所以又称为阵列处理机。阵列处理机中的存储器可以是共享式的(SM-SIMD),也可以是分 布式的(DM-SDMD)。阵列处理机的专用性较强,一般只适合于求解某类算法,工作效率往往很高。单向量机系统中只有一套向量部件,但存储器为向量部件、标量浮点部件和标量整数率往往和部件所共享,因此属于 SM-SIMD 类型。它有较强的通用性,特别是在求解向 量应用问题时,有很高的效率。

当今的超级计算机系统大多以 MIMD 方式工作。多向量机(multi vector processor,MVP)系统中有多套向量部件,但存储器是共享的,因此属于 SM-MIMD 类型。对称多处理器(symmetric multiprocessor,SMP)系统也属于这一类型。MVP 和 SMP 又称为 UMA(uniform memory access)系统,因为系统中所有处理器对任何存储单元有相同的访问时间。与 UMA 系统相对的系统称为 NUMA 系统,在 NUMA 系统中,存储器是分布的,各访问时间和处理器对同一存储单元的访问时间可能是不同的,依赖于处理器在系统中所处的具体物理位置。NUMA 系统属于 DM-MIMD 类型。需要注意的是,NUMA 系统中的处理器可对远程存储器(即非本地存储器)以 load- store 指令形式进行直接访问,因此该系统有一个统一的存储器逻辑地址空间。NUMA 并行机系统按是否对 Cache 一致性提供硬件支持可进一步分为CC-NUMA(cache-coherent)和 NCC-NUMA(non-cache-coherent)。当存储器全由 Cache 组成时就变为 COMA(cache only memory architecture)系统。

如果并行计算机系统中的处理器必须以消息传递的方式访问远程存储器,就称为NORMA(no remote memory access)系统,它也是 DM-MMD 类型。与 NUMA 系统不同, 它有多个存储器地址空间,且系统中的每个处理器是一个独立的计算机。NORMA 系统按计算机间的互连紧密程度,又分为紧耦合和松耦合两种。集群(cluster)系统是松耦合的典型代表,而 MPP 系统则是紧耦合的典型代表。MPP 系统使用大量的商品化处理节点,用定制的高带宽、低时延互连网络将它们连接起来,存储器在物理上是分布的,必须通过消息传递实现进程间的相互通信,是紧耦合的并行机系统,具有良好的可扩展性。Cray T3E 和 IBM Blue/Gene 系统是它的典型代表。

集群系统中每个节点是一个完整的计算机,可能没有某些外设,节点也可以是一台 SMP 或个人计算机(personal computer,PC)等。它采用商品化的互连网设备,节点机通过 I/O 总线与网络接口相连。每个节点机上留驻有一个完整的操作系统,并有一个附加的中间件以支持单一系统映像和高可用性。

(3) 最新发展

自 1996 年以来,由于挑战性应用问题的急切需求,以及超集成电路技术和网络技术的迅速发展,加快了计算机系统结构的演变和发展进程。虽然开发指令级并行性的超标量技术日臻完善,动态预测执行、显性并行指令计算(explicitly parallel instruction computing,EPIC)等方法也已成功应用到商品化产品中,但随之而来的超标量处理器的设计越来越复杂,以至于进一步开发指令级并行性已变得相当困难。另一方面,为了提高性能,微处理器芯片的时钟频率越来越高,导致功耗的急剧增加和组件装配密度的下降。显然,单纯依赖提升单处理器时钟频率和一味开发指令级并行性以提高计算机性能的方法已不再经济有效, 必须加强对线程级和数据级并行性的开发才能大幅提高计算机性能。

(1)异构是指异构并行计算需要同时处理多个不同架构的计算平台的问 题,比如目前主流的异构并行计算平台x86+。并行计算机即能在同一时间内执行多条指令(或处理多个数据)的计算机,并行计算机是并行计算的物理载体。 开发了用于并行处理的多处理操作系统、专用语言和编译器等和编译器等,pdp-8)),vax9000)并行计算机并行计算机并行计算机)器、并行计算机开发了用于并行处理的多处理操作系统、专用语言第五代计算机系统主要特征(第五代计算机系统主要特征(intel paragon)&bull。

异构并行计算包含两个子概念:异构和并行。也就是说,应用可以分解为多个子任务,这些子任务可以并行地执行。在过去gpu只能执行图形任务,不能执行通用计算,所以还称不上异构计算,现在的gpu已经具备了执行通用计算的能力,和cpu协同工作就组成了一个异构计算系统,amd的apu就是其中的一个实现。

随着gpu在超级计算架构中的地位走高,双方又以混合扩展xmp及openacc代码的方式为搭载/协处理器的并行集群系统量身定制了xcalableacc(xacc),通过omni xacc compiler实现相异语法指令间程序无缝移植的同时还支持不同加速设备间/主机内存与加速设备间数据的直接读写通信。google提出了一整套基于分布式并行集群方式的基础架构技术,利用软件的能力来处理集群中经常发生的节点失效问题。集群并行系统中的每个计算机系统可以称为节点机,每个节点机有自己的存储器和i/o设备,因此集群并行计算系统具有基于网络的分布式资源。

(1) 六类设备:

MIC 等),或者直接采用异构处理器,以此提升并行运算效率。异构节点也可以是计算节点。

(2) 三类网络:

高性能计算机节点规模庞大、硬件设备繁多,软件配置复杂。随着用户数量和作业数量的增加、作业队列数目和长度的增加,有必要对高性能计算机进行更加系统的管理和维护以充分发挥其性能。

图 6 浪潮集团建构的超级计算机生态

缓存系统方面,采用全新三级缓存设计,引入新的smart cache智能缓存技术,l1和l2缓存为内核缓存,具有超低延迟,其中l1缓存由32kb指令缓存+32kb数据缓存组成。跟传统的方式(sdram)相比,通过在power7芯片上使用这种动态的共享l3缓存技术(edram),不仅可以让带宽增倍,减少延迟,也可以减少对晶体管的占用,从而减少芯片面积,降低功耗。从宇瞻内存的标贴上,可以看到8gb unb pc3-12800 cl11的字样,这说明此内存的容量为8gb,unb代表unbuffered 无缓存,内存的频率为1600mhz,1600*64/8=12800(内存带宽的计算公式:带宽=频率*位宽/8),1600是ddr内存等效频率,cl11指的是内存默认延迟数值。

图 7 超级计算机应用

目前,这是改进计算机结构,新的海量存储技术趋于成熟计算机的关键技术继续发展。万象松湖】选址松山湖商务核心,随着松山湖高新产业园的确立、国家级实验室的布局,为深入促进基础科学研究成果向应用成果转化,打造东莞未来科学中心区,以梅观、南光、龙大三条高速取消收费开启深莞交通融城的篇章,五大高速环绕松山湖-大朗片区。70年代初,计算机已由昔日单纯运用于以国防和宇航为中心的大型科研,扩展到政府和企业界,并在生产、管理、商业往来、金融服务等方面广为应用。

2.3.1 石油气勘探

石油勘探,尤其是石油地球物理勘探,一直是高性能计算技术的传统和主要应用领域。长期以来,油气地球物理勘探技术的发展与应用高度依赖于包括高性能计算技术在内的信息技术的发展,尤其是近年来“两宽一高”(宽方位、宽频带、高密度)勘探技术的普及,和逆时偏移、全波形反演等一系列处理解释手段的应用,使得石油勘探对超级计算机的需求进一步增加。

本文来自电脑杂谈,转载请注明本文网址:

http://www.pc-fly.com/a/jisuanjixue/article-106231-3.html

-

-

捧剑仆

捧剑仆看见中国日渐强大他毫无办法很迷茫

-

沈清云

沈清云桃子加油

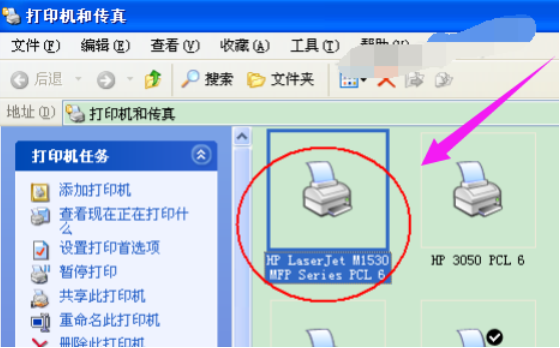

Windows 7驱动程序自动安装和手动更新方法

Windows 7驱动程序自动安装和手动更新方法 有哪些税务风险识别方法?

有哪些税务风险识别方法? 图3 19为地球内部圈层结构_地球的内部圈层结构ppt_地球内部圈层图片

图3 19为地球内部圈层结构_地球的内部圈层结构ppt_地球内部圈层图片 android应用程序后台管理与界面设计 说说如何使用 Android UI 设计聊天界面

android应用程序后台管理与界面设计 说说如何使用 Android UI 设计聊天界面

就换船吧